邊緣AI的贏家?Agentic AI的受惠者?是資安還是網路基礎設施公司? - 深入分析第47期:Cloudflare

你最近或許聽過,華爾街開始將 Cloudflare 稱為「邊緣 AI(Edge AI)的贏家」。

但如果你去詢問不同的人,你會得到截然不同的答案:有人說它是一家「資安公司(Cybersecurity)」,有人把它歸類為「網路基礎設施(Network Infrastructure)」,而 Cloudflare 官方則將自己定義為「連線雲(Connectivity Cloud)」。

為什麼一家公司會有這麼多種面貌,甚至這麼難被單一標籤定義?

想像一下你今天的早晨:你醒來,滑開手機看了一下新聞網站;接著打開電商 App,把一雙猶豫了很久的球鞋放進購物車;通勤時,你順手用 ChatGPT 幫忙整理了一份會議大綱。

在這短短一小時內,你可能已經與Cloudflare的伺服器交手了數十次,而你卻渾然不覺。

在當今的網際網路世界裡,Cloudflare 就像是空氣一樣,看不見,但無所不在。根據統計,全球有將近 20% 網站的流量,都必須經過這家公司的基礎設施。

如果 Cloudflare 當機半小時,全球會有數以百萬計的網站瞬間癱瘓,從華爾街的加密貨幣交易所,到你家巷口咖啡廳的線上點餐系統,無一倖免。

正因為它無所不在,當你打開 Cloudflare 的產品目錄時,會看到 CDN、WAF、DDoS 防護、Workers、Zero Trust、R2 甚至 AI 推論……一堆讓人眼花撩亂的科技名詞。

許多投資人研究到這裡就放棄了,因為它看起來就像個毫無章法的大雜燴。

但事實上,Cloudflare 的擴張邏輯極度嚴謹。要看懂這家公司,你必須回到歷史,看它「怎麼長出來的」。

這是一個關於「先鋪設全球網路基礎設施,然後在上面無極限疊加商業服務」的經典教科書案例。

他們在這十多年間所打下的基礎,正讓它順理成章地成為「AI 時代的神經網路」,這也是為什麼華爾街如今願意給予它極高估值,並將其視為 Edge AI 最大受惠者的真正原因。

寫在最前面

Cloudflare 這個名字,在我腦海裡盤旋了很久。

過去寫資安產業時有人問,寫 SaaS 趨勢時也有人問。我的回答總是同一句:「會寫的,等我。」

不是故意拖延,而是這家公司實在太難被三言兩語定義。把它簡單歸類為 Zscaler 的對手?太片面。塞進任何一個傳統 SaaS 的板塊?都不對。

Cloudflare 的業務是一張隨時間不斷擴張的網路,硬把它塞進某個框架,反而會誤導投資人。

直到最近,兩件事同時發生,讓我覺得是時了:一是高盛最新 AI 基礎設施報告將它列為首選之一;二是 Q1 財報公布後,股價經歷了單日近 24% 的劇烈修正。

市場的情緒分歧,恰恰是釐清真相的最佳切入點。

必須先說清楚:這份報告的目的,從來不是喊單「現在買入」。

我的寫作原則一向是,我希望任何人在按下交易鍵之前,只要認真讀過我的內容,都能清清楚楚知道:自己買的是什麼?錢流向哪裡?風險的邊界在哪?

這期的分析非常長,但我敢說,這會是中文世界目前最系統、最貼近商業實況的 Cloudflare 深度拆解。

讀完之後,你不會只看到一堆令人眼花的科技名詞,而是能看懂它的真正業務邏輯,以及支撐當前估值的原因與隱憂。

讓我們把時間倒轉回 2010 年,看看這個網路帝國,最初是如何從一個免費的工具開始萌芽的。

第一章:第一階段(2010-2015)── 免費的「網路門神」與「地方快遞員」

Cloudflare 的誕生,源自於一個非常樸素的煩惱:垃圾郵件。

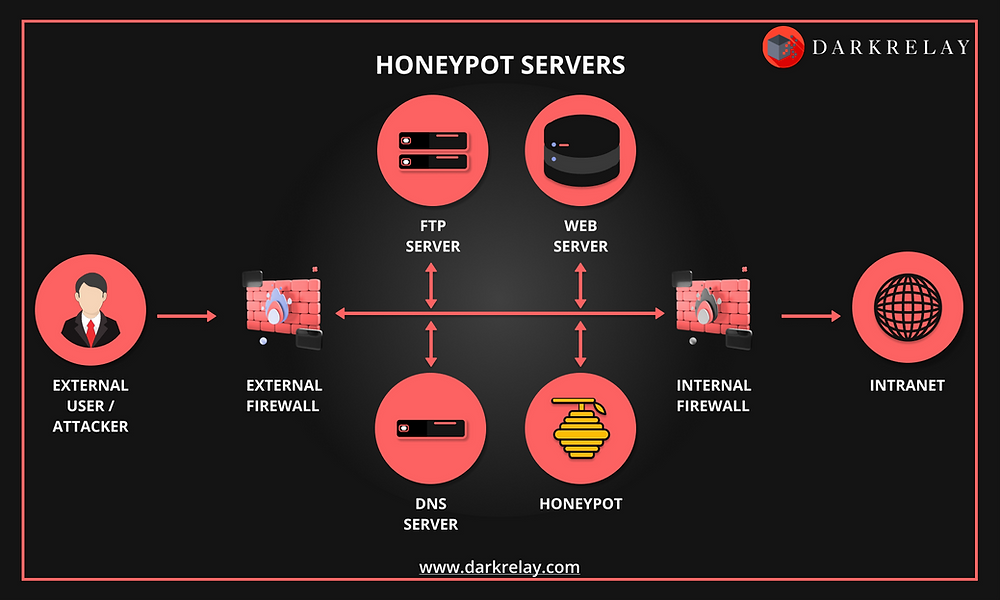

2004 年,兩位創辦人 Matthew Prince 和 Lee Holloway 搞了一個名為 “Project Honey Pot”(蜜罐計畫)的開源專案。

這個計畫的邏輯很簡單:他們在網路上設置許多陷阱(蜜罐),專門用來追蹤那些自動抓取電子郵件地址並發送垃圾信件的駭客程式。

幾年下來,這個計畫大獲成功,他們掌握了全球大量惡意 IP 的名單。這時,另一位共同創辦人 Michelle Zatlyn 加入了,她提出了一個想法:「既然我們已經知道壞人是誰、從哪裡,我們為什麼不直接幫網站擋住這些壞人,並把它變成一門生意?」

1.1 Cloudflare的初始業務

2010 年,Cloudflare 正式成立。在它發展的最初五年,它主要為市場提供兩項核心服務。為了方便理解,我們可以用兩個實體世界的職業來比喻:

1. 網路門神(WAF 與 DDoS 防護)

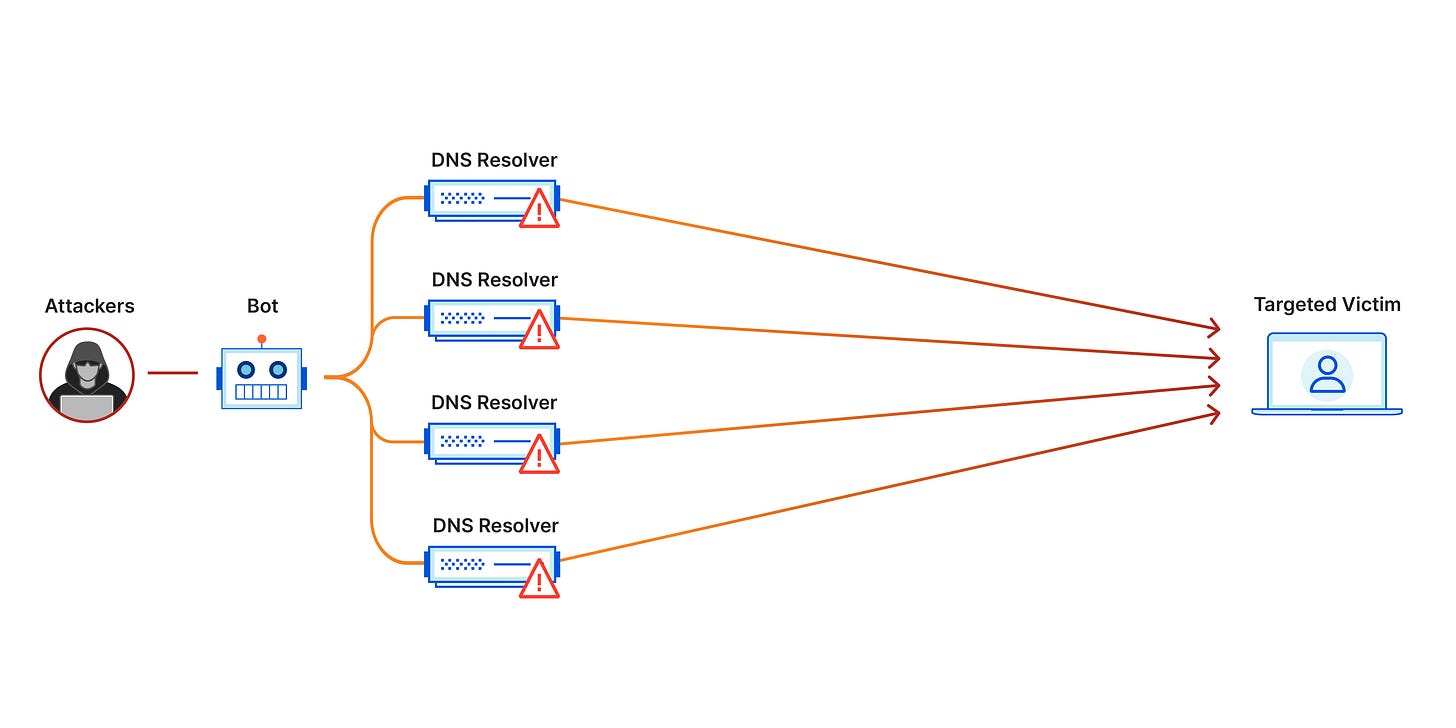

想像你在東區開了一家熱門的限量球鞋店。有一天,你的競爭對手雇了五千個小混混,把你的店門口擠得水洩不通。他們不買東西,就是站在那裡發呆,導致真正想買鞋的客人根本進不去。

在網路世界裡,這就叫做 DDoS 攻擊(分散式阻斷服務攻擊),駭客用巨大的垃圾流量癱瘓你的網站。

Cloudflare 提供的第一項服務,就是充當你店門口的「保鑣(網路門神)」。

當你把網站接入 Cloudflare 後,所有要造訪你網站的流量,都必須先經過 Cloudflare 的伺服器。Cloudflare 就像一個經驗豐富的保鑣,它會檢查每一個訪客的 ID。

如果是正常客人,請進;如果是那五千個小混混(惡意流量),Cloudflare 會直接在門外把他們攔下,確保你的網站安然無恙。

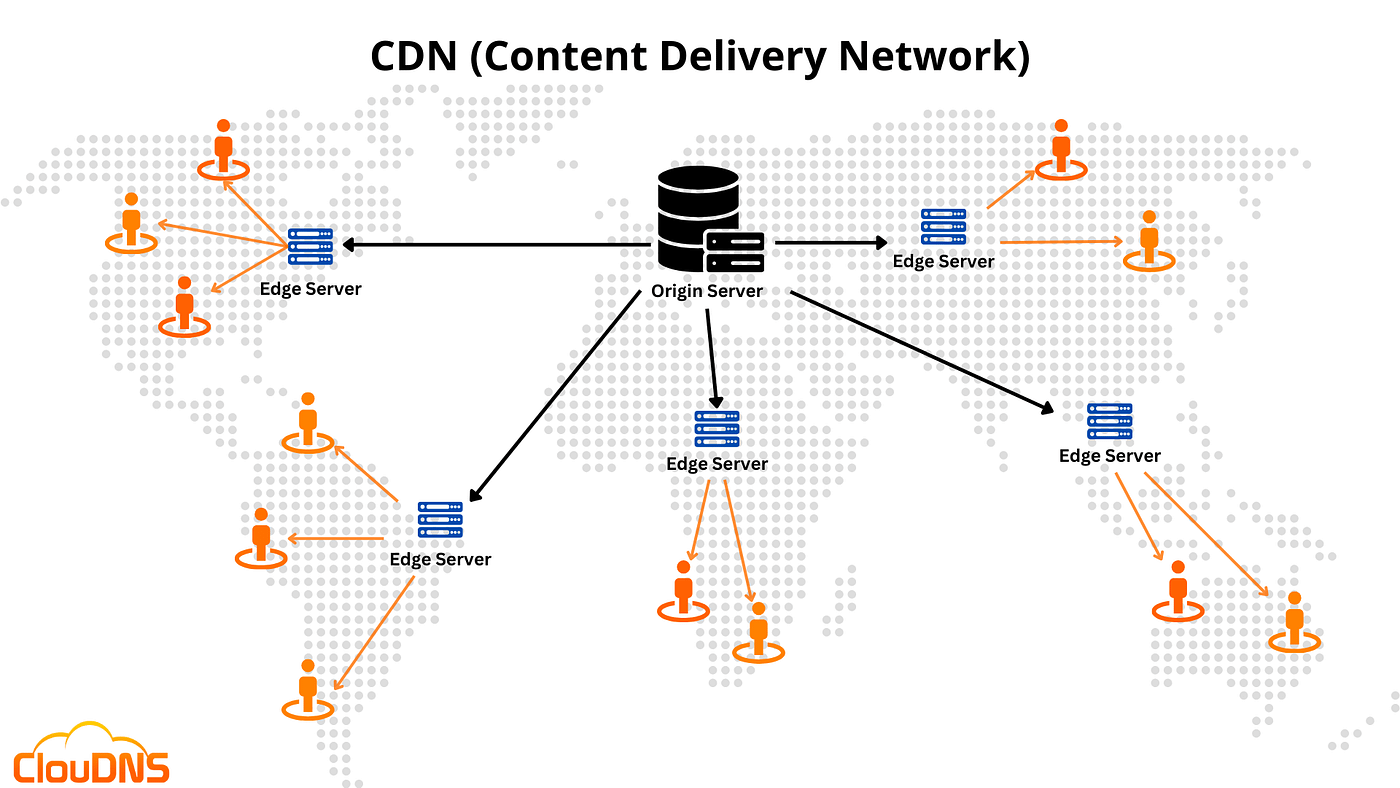

2. 地方快遞員(CDN 內容傳遞網路)

解決了安全問題,接下來是「速度」。

假設你的伺服器架設在美國紐約,但今天有一個台灣的讀者想看你的網站。每一次點擊,數據都要橫跨太平洋海底電纜,來回一趟可能需要幾百毫秒。在網路世界,超過三秒載入不出來的網頁,消費者就會直接關掉。

Cloudflare 的解法是 CDN(Content Delivery Network)。他們在台北、東京、倫敦等全球各大城市租用機房。

當台灣讀者第一次造訪紐約的網站時,Cloudflare 會把網站上的圖片、影片等靜態內容,順便「影印」一份,存放在台北的機房裡(這叫做快取 Cache)。

隔天,當第二個台灣讀者想看同一個網站時,他不需要再大老遠連線到紐約,Cloudflare 的台北機房(地方快遞員)會直接把備份好的圖片派送給他。網頁載入時間瞬間從幾百毫秒,縮短到幾毫秒。

1.2 用「免費」打造護城河

如果只是做保鑣和快遞員,Cloudflare 頂多只是一家普通的 IT 公司(當時市場上早已有 Akamai 這種老牌 CDN 巨頭)。

Cloudflare 特別的地方,在於它的定價策略。

Cloudflare 一開始就決定:將這套基礎服務,免費提供給全世界的小型網站和個人部落格。

在當時,許多人覺得這家公司瘋了。基礎設施(伺服器、頻寬)都是要燒錢的,你讓幾百萬個不賺錢的免費仔佔用你的資源,這生意怎麼做?

但 Cloudflare 看透了資安產業的本質:在網路安全的世界裡,數據(Data)就是最強的護城河。

那幾百萬個免費的小網站,根本不是在佔便宜,他們是 Cloudflare 佈建在全網的「早期預警雷達網」。

試想這個場景:一個位於俄羅斯的新型駭客組織,試圖用一種全新的手法,攻擊台灣某個不知名的免費美食部落格。當攻擊發生的那一瞬間,Cloudflare 的防護網立刻偵測到了這個異常行為,並記錄下這個駭客的 IP 與攻擊特徵。

在接下來的幾秒鐘內,Cloudflare 的 AI 系統會將這個駭客的特徵,同步更新到全球所有的機房。

這意味著什麼?這意味著當這個俄羅斯駭客轉過頭來,準備去攻擊 Cloudflare 真正付費的「大客戶」(例如紐約的華爾街銀行、大型跨國電商)時,他會發現自己已經被全網封殺了。

這就是 Cloudflare 最重要的「數據飛輪效應」(Data Flywheel)。免費客戶貢獻了龐大的攻擊數據,這些數據訓練了 Cloudflare 的防禦系統,讓防禦力變得極度強大;而極度強大的防禦力,吸引了願意捧著大把鈔票來買單的企業級客戶;企業級客戶帶來的營收,又讓 Cloudflare 有錢去全球擴建更多的機房。

1.3 破解 Cloudflare 的硬體擴張之謎

既然收了這麼多「免費仔」,他們是怎麼有錢去全世界買伺服器、蓋機房的?

這就帶出了 Cloudflare 擴張史上關鍵的一招:一開始,他們根本不「蓋」機房,而是「依附」在別人的機房裡。

AWS 的做法是花幾億美金買地蓋超級資料中心。但 Cloudflare 的做法是:

買便宜貨: 大量採購市面上最標準、最便宜的通用伺服器。

與當地電信商(ISP)互惠合作: 他們直接去找全球各地的電信商(例如台灣的中華電信)。Cloudflare 告訴電信商:「你看,我有幾百萬個免費網站的流量,你的用戶每天都要連到美國去看這些網站,害你要付很貴的海底電纜過路費。不如這樣,你免費在你的機房裡清出幾個櫃子給我放伺服器,我幫你把內容快取在當地,幫你省下龐大的跨國頻寬費!」

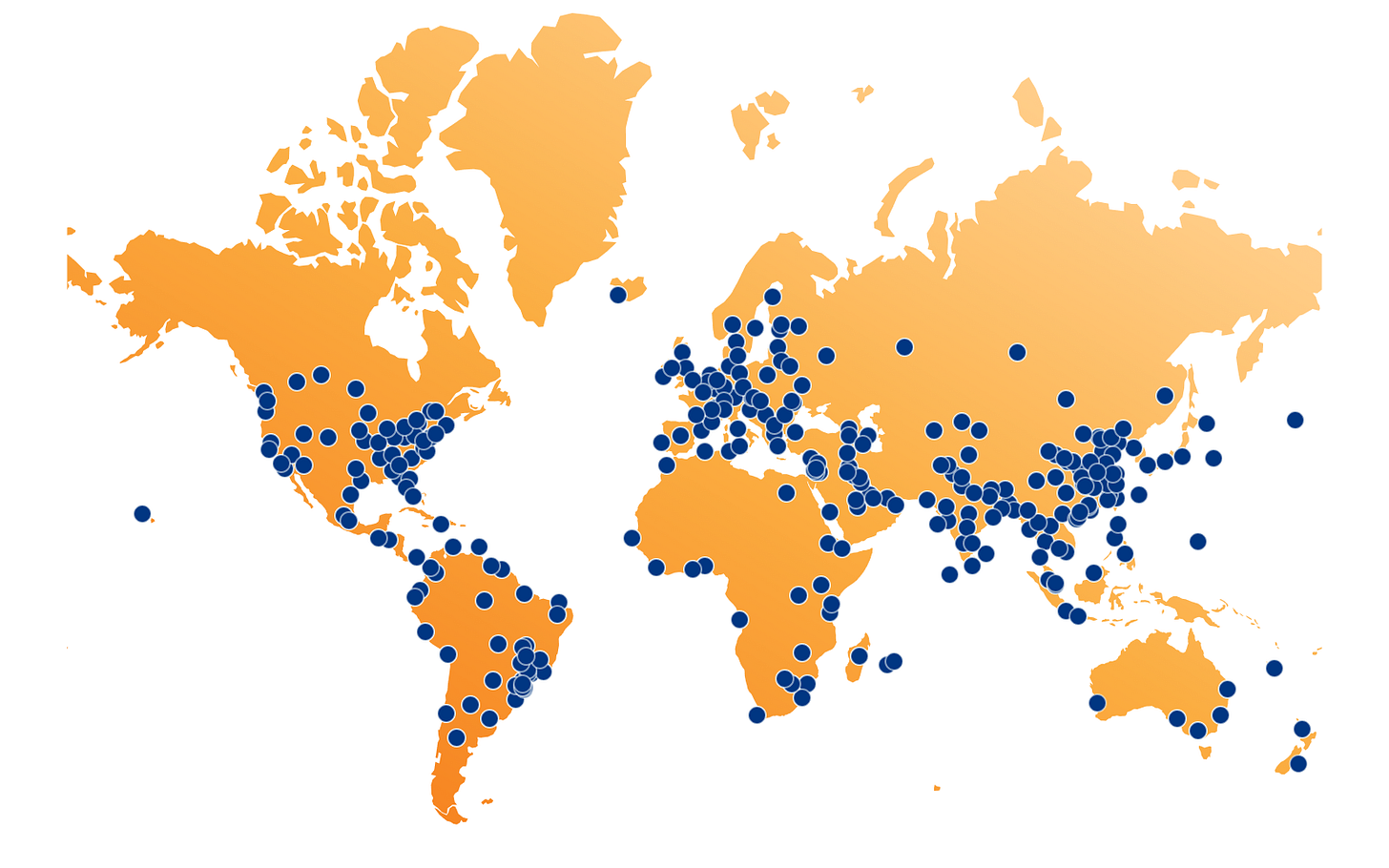

電信商一算發現太划算了,於是紛紛讓 Cloudflare 把伺服器「塞進」他們現有的機房裡。透過這個策略,Cloudflare 幾乎以「極低的資本支出」,在全球各大城市佈滿了伺服器節點。

透過這個策略,Cloudflare 在 2015 年左右,幾乎是以「極低的資本支出」,在全球各大城市佈滿了伺服器節點,手握全網最龐大的流量數據。他們就像是在全世界的高速公路上,都蓋好了自己的收費站與檢查哨。

(值得補充的是,這個「純依附」策略並非一成不變。隨著 Cloudflare 業務從單純的 CDN 轉向邊緣運算、儲存,特別是 2023 年後大規模部署 GPU 做 AI 推論,對機房的電力、冷卻、空間規格要求大幅提高,純粹塞進電信商機房已經不夠。

Cloudflare 近年也開始租用或建置規格更高的大型 PoP。但這個早年打下的「輕資產基礎」,讓他們在同樣的資本支出下,能比 AWS 在更多城市提供服務,這個結構性優勢至今仍然成立。)

第二章:第二階段(2017起):把工廠搬到客戶家門口 ──「邊緣運算」的誕生

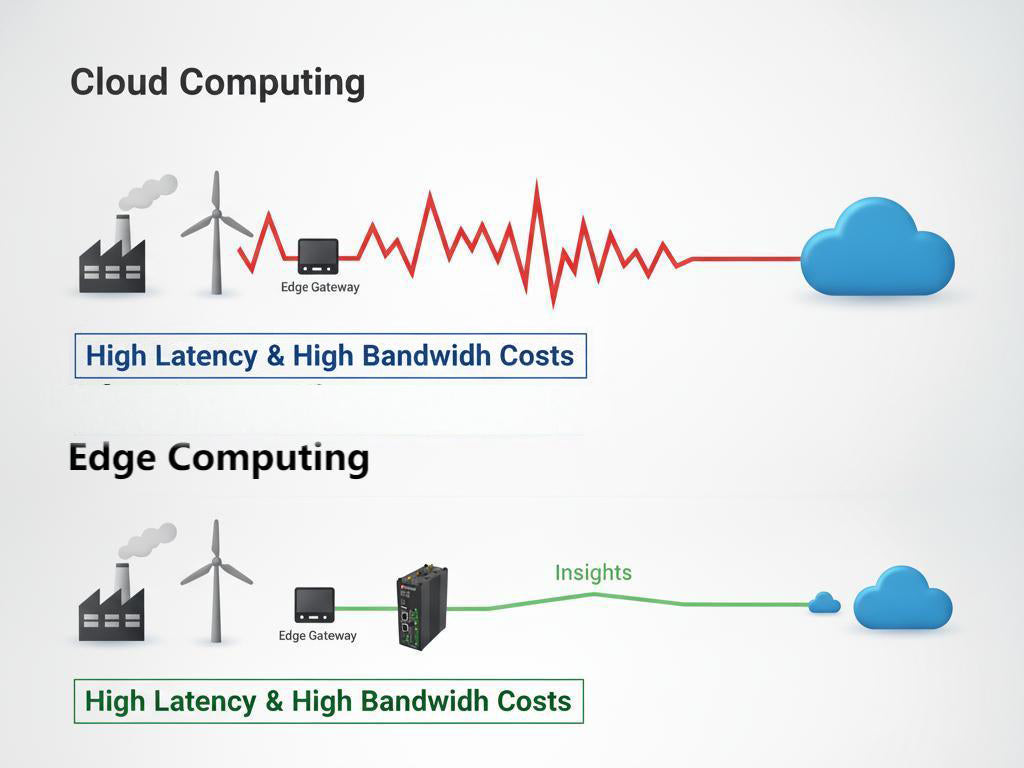

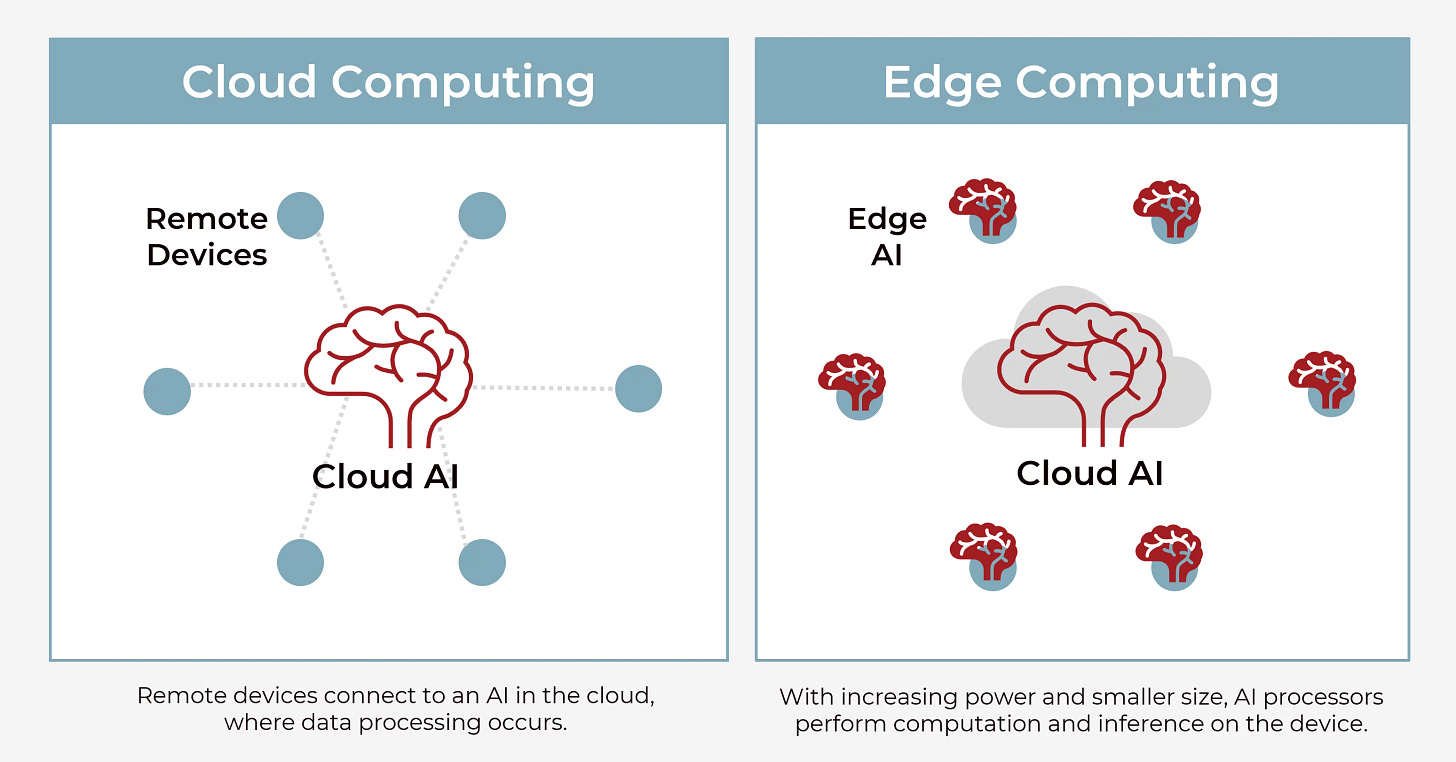

傳統的雲端巨頭(如 AWS、Google Cloud)就像是建在深山裡的「超級大工廠」。這種集中式的超級工廠有一個致命傷,那就是「物理距離帶來的延遲(Latency)」。

但要讓你真正感受到這個延遲為什麼是個問題,我們得先看一個 CDN 解決不了的場景。

2.1 一個 CDN 救不了的場景

想像你打開蝦皮搜尋一雙球鞋,網站秒速跳出「為你推薦」的清單,這雙鞋是你昨天看過的、那雙鞋是你朋友剛買的、價格還根據你的所在地顯示了當地幣別。這個畫面背後,藏著一個 CDN 解決不了的問題。

CDN 能把球鞋的「圖片」事先存在台北機房,讓你載入很快。但「為你推薦」這四個字背後的判斷,「這個用戶是誰?他昨天看了什麼?他在哪個城市?該推薦什麼?」,這些不能事先準備好,必須在你點開頁面的那一瞬間,根據你這個人即時計算出來。

過去,這種「即時個人化計算」只能在遠方的中央伺服器處理。當你在台北或香港點下搜尋按鈕時,請求要先跨海到美國維吉尼亞州的 AWS 伺服器,那邊算完「該推薦什麼」之後,再把結果跨海送回你的手機。

一來一回,將近 500 毫秒,你會覺得網站「卡了一下」。

到了 2017 年,Cloudflare 的高層看著自家遍布全球的機房(原本是用來做保鑣和快遞員的),突然靈機一動:

「既然我們在全世界每個客戶的家門口都有一個小機房,我們為什麼不直接讓開發者在這些小機房裡『寫程式』?」

這一個戰略轉折,催生了 Cloudflare 歷史上最具革命性的產品:Cloudflare Workers。

2.2 Workers 在做什麼?

還記得上面那個蝦皮的場景嗎?Workers 做的事就是:把「該推薦什麼」這個運算過程,從「美國維吉尼亞」搬到了「台北」或「香港」。

當你按下搜尋的瞬間,這個判斷直接在離你最近的 Cloudflare 機房算完,5 毫秒內結果就回到你手機上。

CDN 是「把預先做好的便當送到你家附近的便利商店」。

Workers 是「在便利商店現場開了一個小廚房,根據你今天的口味現炒一份」。

CDN 處理「靜態」的內容(圖片、影片這種事先做好的東西);Workers 處理「動態」的運算(必須當下計算的東西,例如個人化推薦、即時翻譯、購物車計算、A/B 測試、身份驗證)。

這也是為什麼開頭那段「中午點外送,App 在 0.3 秒內算出 50 家餐廳的即時排序與個人化推薦」會成立,那種「根據你這個人、在你這個位置、用你的點餐歷史」即時算出來的結果,正是 Workers 最典型的應用場景。

2.3 為什麼這在 Cloudflare 之前做不到?

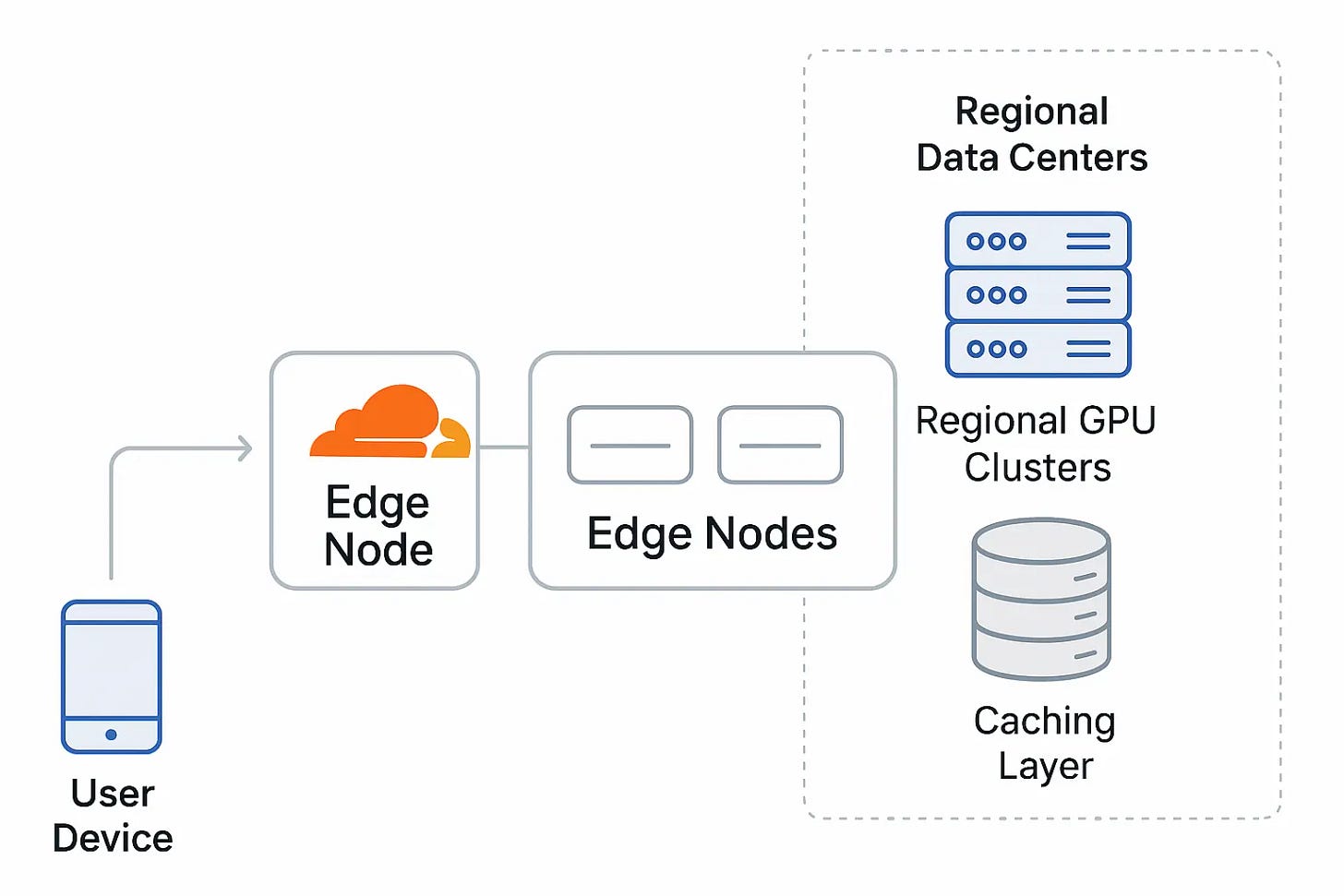

你可能會問:「為什麼 AWS 不能做這件事?」AWS 當然可以在維吉尼亞跑這些運算,但它沒有 Cloudflare 在全球 330 個城市鋪好的機房。

當 AWS 想要做「邊緣運算」時,它只能在十幾個區域中心提供服務。

而 Cloudflare 從第一天起就為了 CDN 蓋了 330 個城市節點,當 Workers 推出時,這 330 個節點同時變成了 330 個「小型運算中心」。

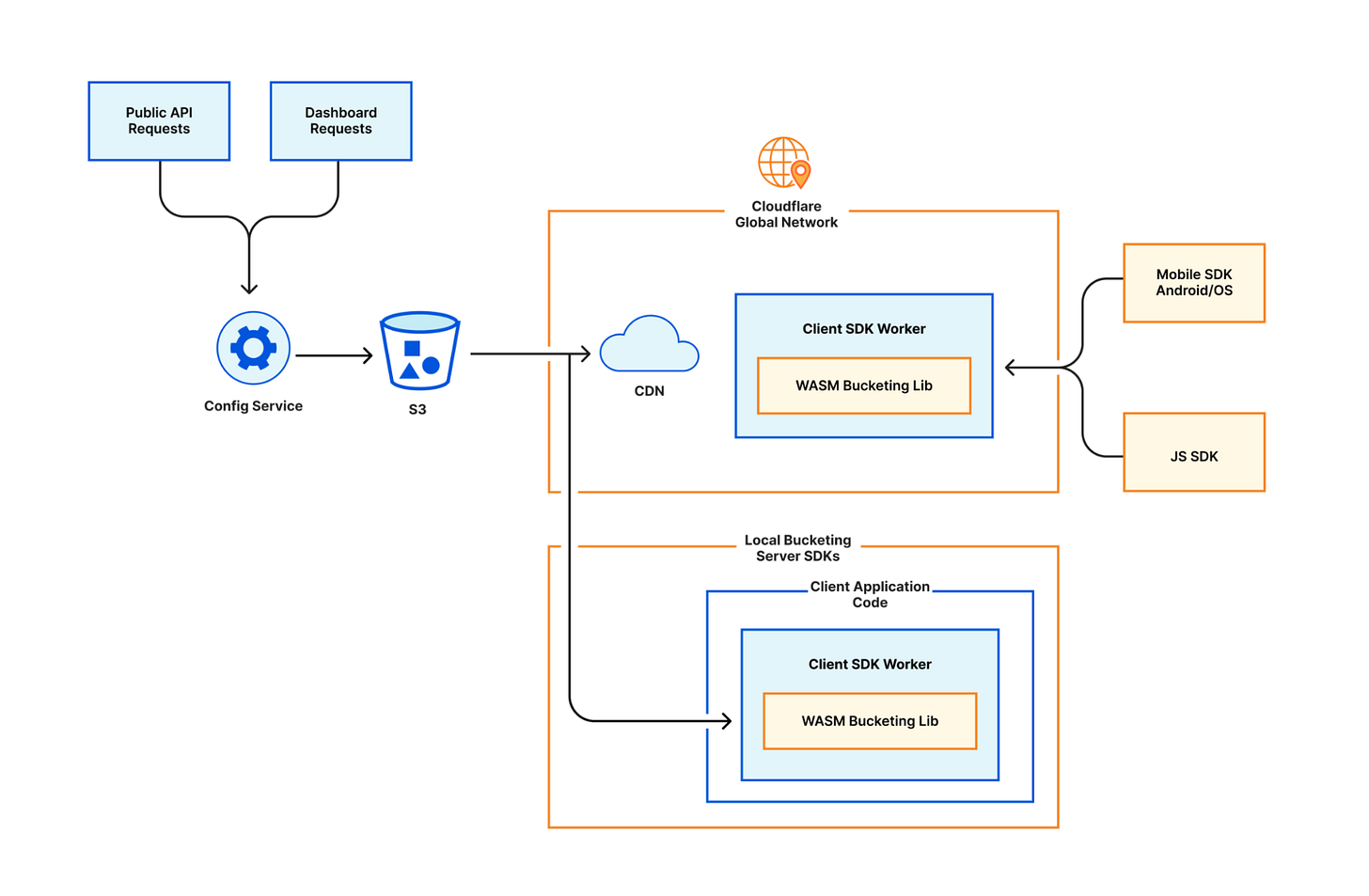

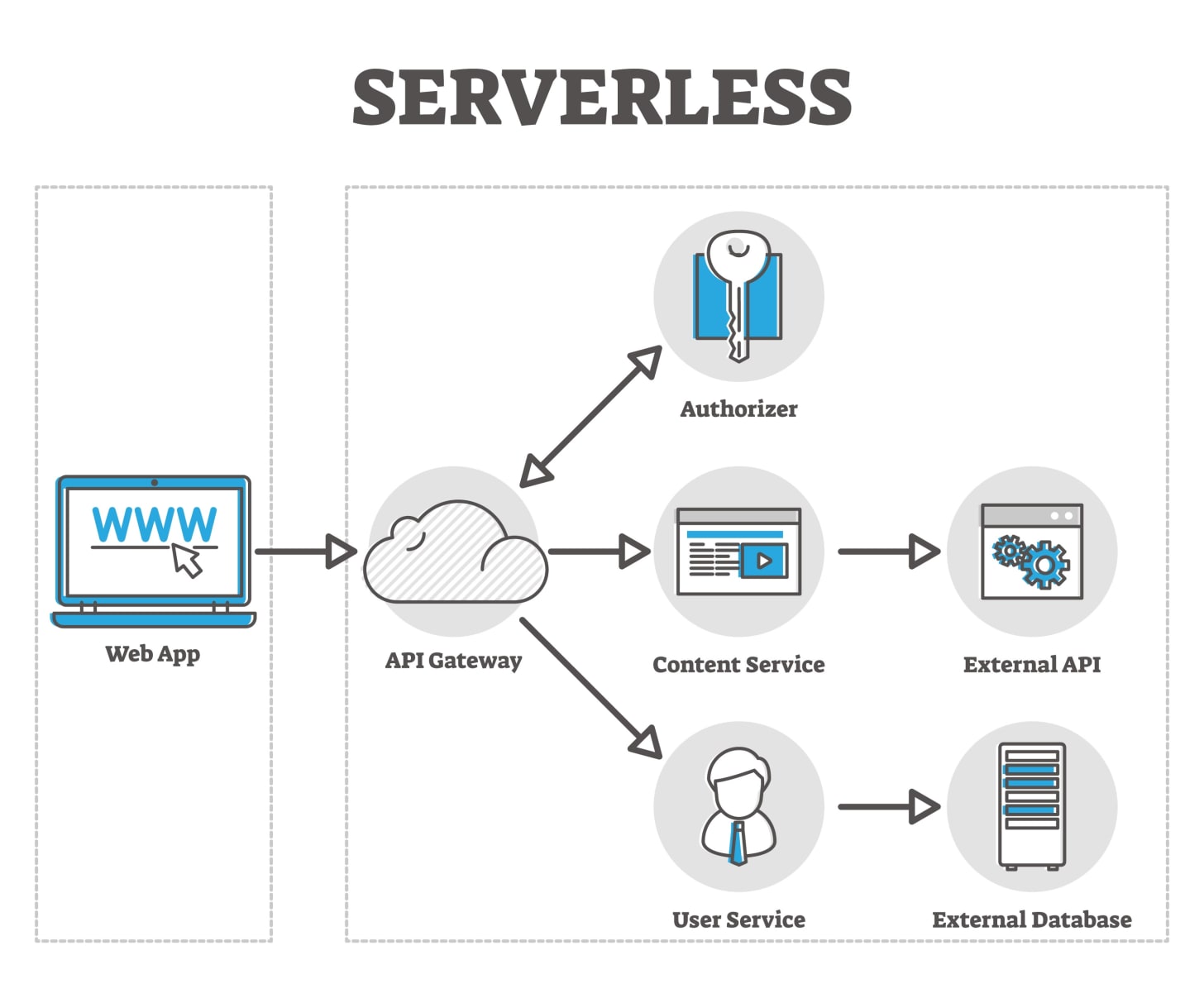

換句話說,Workers 是 Cloudflare 基於過去十年鋪設的物理網路,自然延伸出的第二種變現模式。這也帶出了 Workers 的另一個革命性特徵:「無伺服器(Serverless)」。

工程師不再需要管「伺服器在哪裡、有幾台、夠不夠用」,你只需要把程式碼上傳一次。

當東京的用戶發出請求時,Cloudflare 會自動在距離他最近的「東京機房」喚醒程式碼並執行;當倫敦的用戶發出請求時,倫敦機房接手。程式碼跟著使用者跑,而不是使用者跑去找程式碼。

2.4 從「單一功能」到「完整的開發者生態」

起初,Workers 只能處理簡單的輕量級任務。但 Cloudflare 的野心不止於此。為了讓開發者能把越來越多的應用程式直接建構在邊緣網路上,他們陸續把整套雲端基礎設施都搬到了邊緣。

用一個比喻來看清楚這個堆疊:Cloudflare 把這套「邊緣運算平台」蓋成了三層樓。

最底層的地基:Workers

一個可以在 330 個城市同時執行程式碼的引擎。這是整套架構的心臟,跑在 CPU 上,處理通用運算。

中間層的水電管線:資料服務

R2(對標 AWS S3)、D1(關聯式資料庫)、KV、Durable Objects。這層讓開發者寫的程式有資料可以讀寫,不用再大老遠連回 AWS 拿資料。

頂樓的招牌:Workers AI

在 Workers 的基礎設施上裝了 GPU,讓開發者可以直接在邊緣節點呼叫 AI 模型(Llama、Stable Diffusion 等)。當別人在搶「誰能訓練最大的模型」時,Cloudflare 在搶「誰能讓 AI 推論離使用者最近」。

這三層的關係很簡單:Workers 是地基、資料服務是水電管線、Workers AI 是頂樓的招牌。

這意味著 Cloudflare 已經實質上成為了一家「真正的雲端運算公司」。開發者完全可以不依賴 AWS,直接在 Cloudflare 的平台上建構、運行完整的應用程式,而且這些程式天生就具備全球最低的延遲。

這對 AWS 來說是一個危險的訊號。Cloudflare 就像是在 AWS 的超級工廠外圍,建了一圈密密麻麻的「地方微型加工廠」。

那些需要極致速度、輕量化的運算任務,開發者不再需要大老遠跑去 AWS,直接在 Cloudflare 的邊緣網路上就能秒速解決。

第三章:第三階段(2020起):疫情催化的質變 ── 從「保護網站」到「保護企業」

如果說邊緣運算是技術上的突破,那麼 2020 年爆發的 COVID-19 疫情,則是 Cloudflare 商業版圖(TAM,總體可用市場)產生爆發性擴張的催化劑。

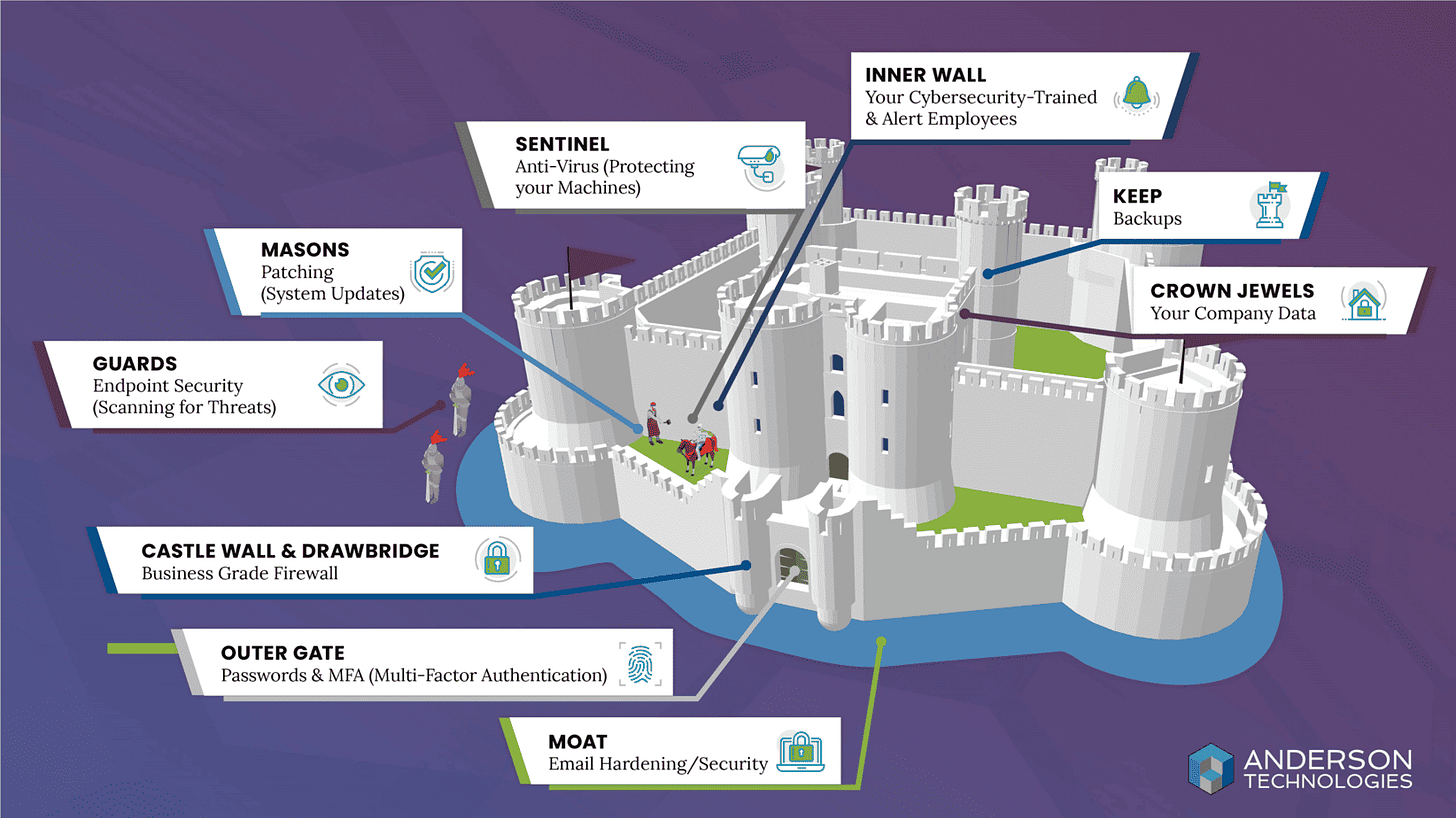

在疫情之前,傳統企業的資訊安全邏輯叫做「城堡與護城河(Castle and Moat)」。

公司就像一座城堡,所有的員工都在城堡(辦公室)裡上班,公司的機密資料也鎖在城堡裡。資安長的工作很簡單:花大錢買很厚的硬體防火牆,把城堡包圍起來。

只要你在城堡內,你就是「自己人」;在城堡外,你就是「潛在威脅」。如果員工偶爾出差,就透過 VPN(虛擬私人網路)挖一條秘密地道連回城堡。

但 2020 年,疫情讓世界停擺了。

一夜之間,城堡空了。所有的員工散佈在各地的星巴克、家裡的沙發、甚至海外的渡假村工作。

幾千個員工同時試圖透過那條狹窄的 VPN 地道連回公司,結果就是系統全面崩潰、連線速度慢如牛車,而且只要一個員工的家用電腦中毒,駭客就能順著地道直接攻入公司總部。

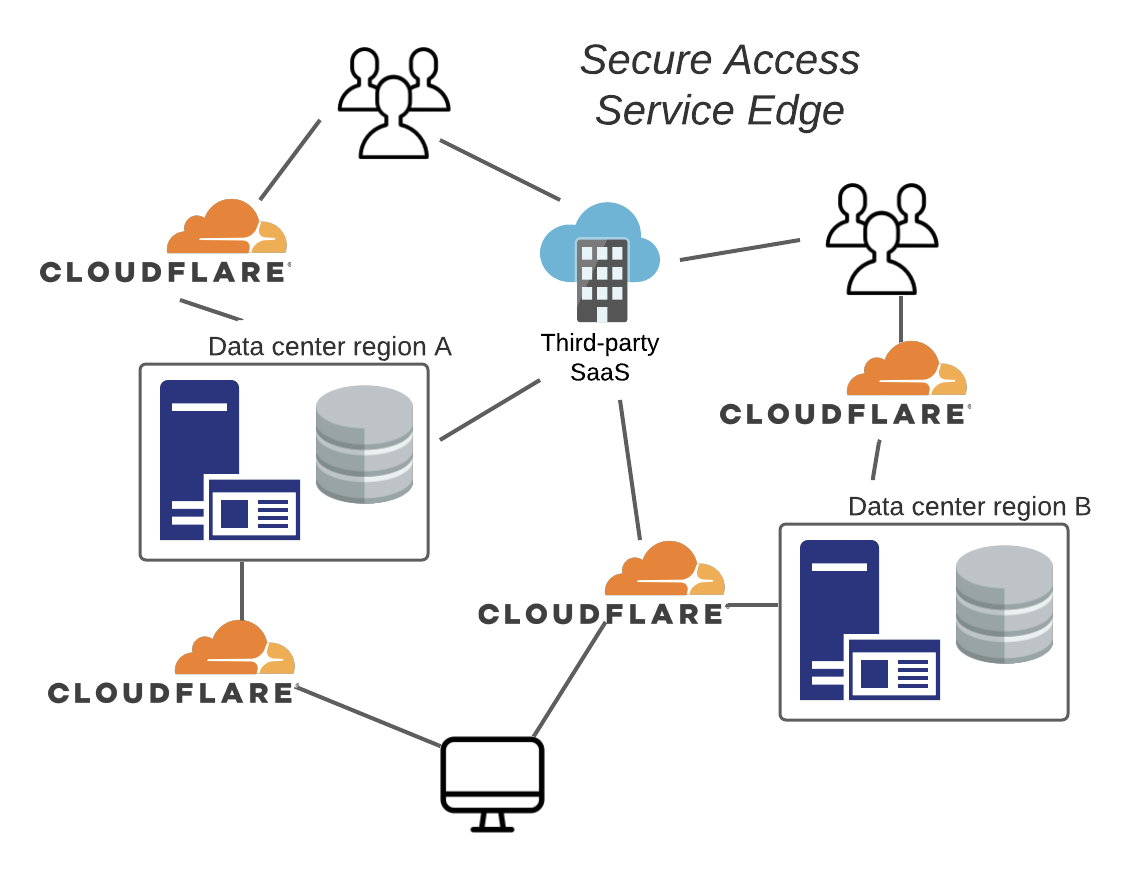

傳統的企業資安架構,在遠距工作時代徹底失靈。這時,Cloudflare 帶著 Cloudflare One(零信任架構Zero Trust) 正式進軍該領域。

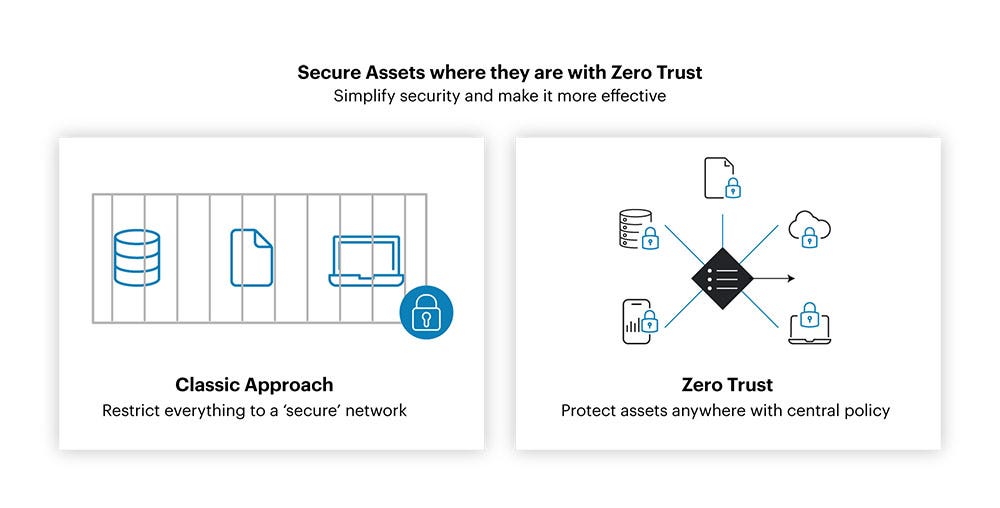

3.1 什麼是「零信任」?

它的核心邏輯是:

「絕對不信任任何人,始終進行驗證」。

在零信任的世界裡,沒有所謂的「城堡內部」。無論你是坐在公司總部大樓裡,還是坐在峇里島的海灘上,只要你想開啟一份公司機密文件,系統都會問你一次:「你是誰?你的設備安全嗎?你有權限看這份文件嗎?」

這是一個極具歷史意義的戰場轉移。Cloudflare 正式跨界,向 Zscaler(零信任架構的開拓者)與 Palo Alto Networks(傳統防火牆霸主)發起了挑戰。

這時你可能會問:「為什麼是 Cloudflare?它比那些傳統資安大廠有甚麼優勢嗎?」

要實現零信任,意味著員工的「每一次」點擊、每一次開啟檔案,都要經過一個雲端的「檢查哨」。

如果這個檢查哨建在遙遠的集中式資料中心,員工的上網速度就會產生嚴重的延遲(這在 IT 界被稱為「髮夾彎效應」,資料要繞一大圈才回來)。

但別忘了 Cloudflare 過去十年在做什麼。

無所不在的檢查哨: 他們在全球近 300 個城市、幾乎每個人的家門口,都已經建好了邊緣機房。

天生的保鑣基因: 他們原本就是世界上最專業的流量清洗中心,每天幫數百萬個網站檢查進出的封包,過濾惡意程式。

Cloudflare 只是做了一個「反向操作」:

過去,保鑣是站在「網站」前面,擋住外面的壞人;現在,他們讓保鑣站在「員工」前面,保護員工連線的安全。

當一個在家上班的員工想要連線到公司內網時,他不再需要大老遠連回公司總部。他的連線會先連到「離他家最近的 Cloudflare 機房」。

Cloudflare 會在這個機房裡,瞬間完成身分驗證、病毒掃描、權限控管。因為檢查哨就在家門口,加上 Cloudflare 專屬的網路快車道,員工不僅感覺不到安全檢查的延遲,上網速度甚至比以前用 VPN 時更快。

Cloudflare 告訴全世界的企業老闆:

「你們不需要再買昂貴的硬體防火牆,也不需要忍受難用的 VPN。把你們所有的員工連線都交給我的全球網路吧,我會讓他們上網更快,而且絕對安全。」

3.2 Zscaler 不是吃素的

看到這裡你可能會有一個疑問:零信任這個概念又不是 Cloudflare 發明的。早在 2008 年就創立的 Zscaler,才是這個領域公認的領先者。

他們十幾年來在財星 500 大企業裡深耕,客戶包含國防部、大型金融機構,護城河之深,豈是 Cloudflare 一個「半路出家」的 CDN 公司可以撼動的?

這個懷疑完全合理。事實上,如果你翻開 2024 年 Dell’Oro 的 SSE(安全服務邊緣)市佔報告,Zscaler 以 34% 的市佔遙遙領先,而 Cloudflare 甚至不在前六名的名單裡。

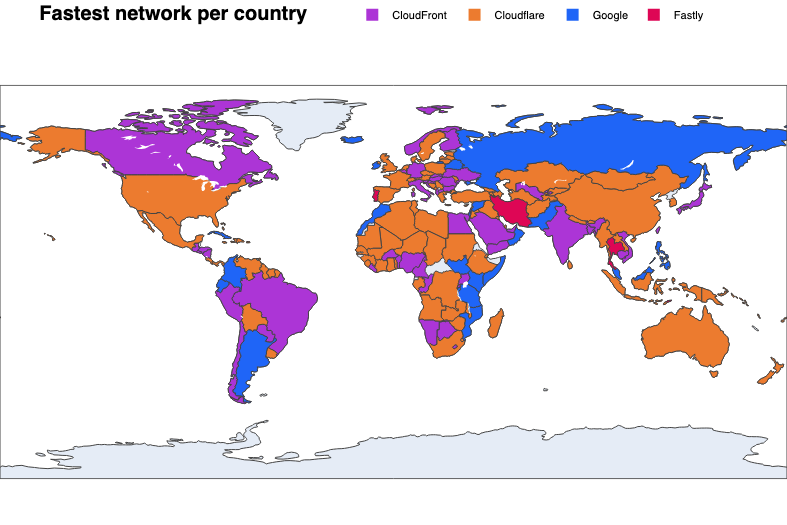

但華爾街真正看重的,從來不是「現在誰是第一名」,而是「誰的增長速度更快」。

而 Cloudflare 在做的事情,就是明目張膽地搶 Zscaler 的地盤。

他們甚至懶得掩飾。打開 Cloudflare 官網,你會找到一個名為「Cloudflare vs. Zscaler」的專屬頁面,裡面用超過 37 項指標逐條拆解兩家的架構、效能、部署難度、創新速度。這種等級的對標網頁,在 B2B 軟體業幾乎是「指名叫陣」的意思。

Cloudflare 的執行長 Matthew Prince 在法說會上也毫不客氣地說:「在我們與第一代零信任廠商的正面對決中,我們的勝率非常強勁。」所謂的「第一代廠商」,市場都知道他指的是誰。

至此,Cloudflare 已經從一個免費的防駭客小工具,長成了一隻橫跨「內容傳遞」、「邊緣運算」與「企業資安」的三頭巨獸。

而接下來,他們準備好要正面迎戰雲端世界真正的老大哥了。

第四章:第四階段(2021起):向老大哥宣戰 ── 打破 AWS 的「資料過路費」

到了 2021 年,這家公司的戰略發生了根本性的轉變——它不再滿足於只做別人網站的保鑣,它決定建立自己的雲端生態系,向真正的雲端龍頭發起進攻。

當時的 Cloudflare 面臨一個戰略上的「斷點」。

他們已經鋪設了全球最快的網路,也推出了革命性的邊緣運算(Workers)。許多開發者非常喜歡在 Cloudflare 的平台上寫程式,但卻遇到了一個問題:「我的資料要存在哪裡?」

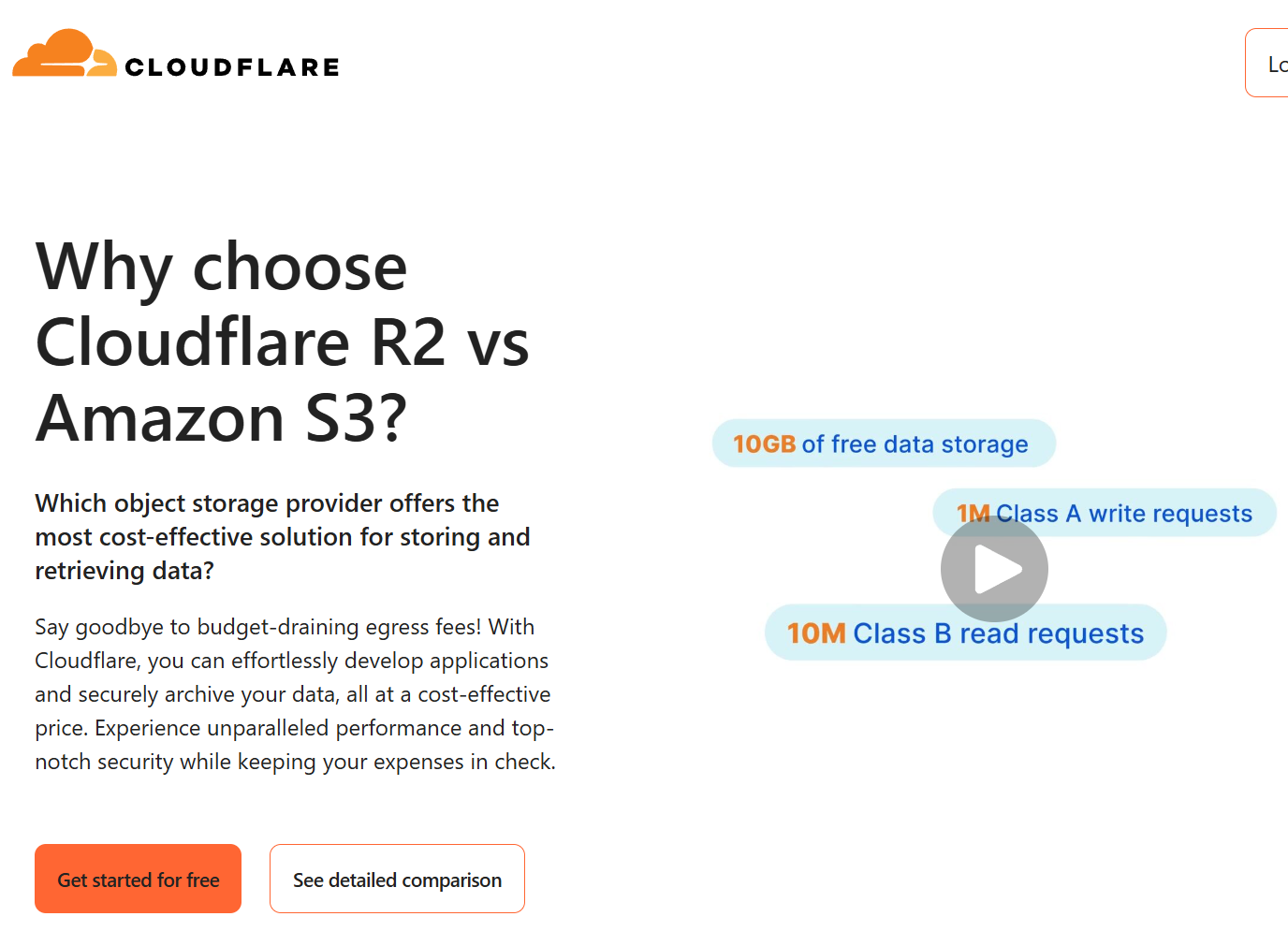

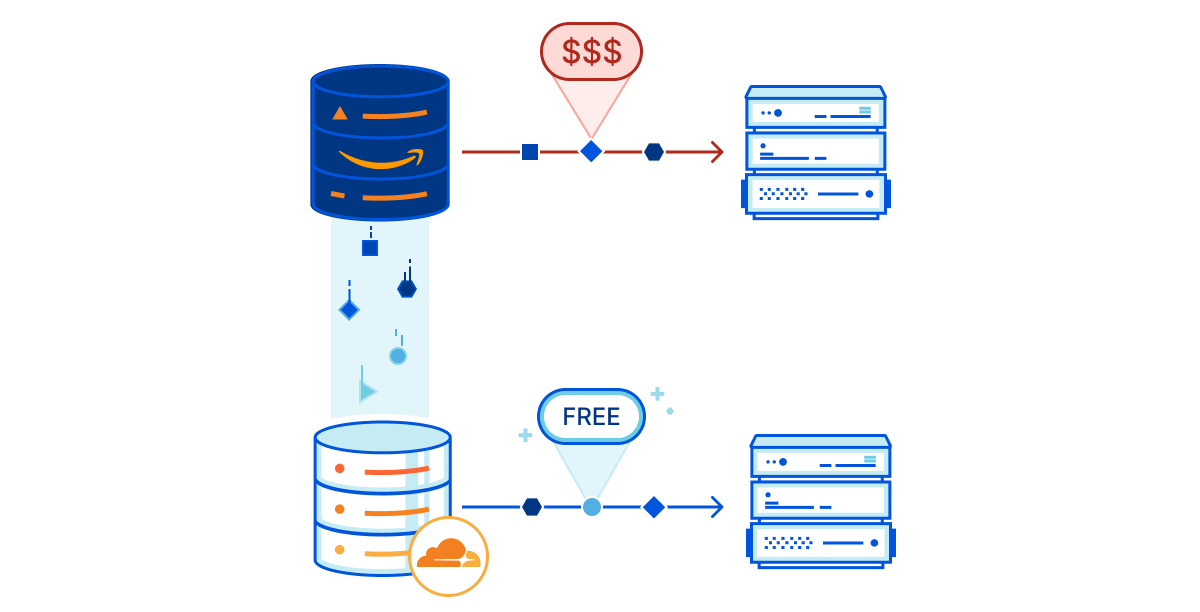

過去,全世界絕大多數的開發者都習慣把資料存在 AWS 的 S3(雲端儲存服務)裡。當開發者想用 Cloudflare 的 Workers 跑程式,並從 AWS 把資料叫出來時,AWS 就會按流量收取極為昂貴的「資料傳出費(Egress Fees)」。

這就像是 Cloudflare 蓋好了一條全世界最快的高速公路,但 AWS 卻在交流道口設了一個收費站。

只要資料還被鎖在 AWS 裡,開發者就無法完全擁抱 Cloudflare 的生態系。為了補上這最後一塊拼圖,打破 AWS 的資料綁架,Cloudflare 推出了 R2 雲端儲存服務。

4.1 什麼是「資料傳出費」?

在 AWS 的世界裡,把資料「存進去」(Ingress)是免費的,每個月的儲存費也很便宜。

但是,如果你今天想把資料「拿出來」傳給用戶,或者轉移到其他雲端平台處理,AWS 就會按流量向你收取極為昂貴的「資料傳出費」。

這就像是著名歌曲Hotel California的歌詞:「You can check out any time you like, but you can never leave」

AWS 透過便宜的儲存把你的資料「綁架」在他們的資料中心裡。因為把資料搬走的過路費太貴了,開發者最後只能妥協:「既然資料都在 AWS,那我乾脆連運算(EC2)、資料庫等其他服務,都繼續用 AWS 好了。」這就是雲端巨頭的護城河。

4.2 為什麼 Cloudflare 敢做到「零傳出費」?這不虧本嗎?

這正是最令人困惑的地方:頻寬難道不用錢嗎?Cloudflare 憑什麼不收費?答案要從兩個層面來看。

第一層是成本結構優勢。

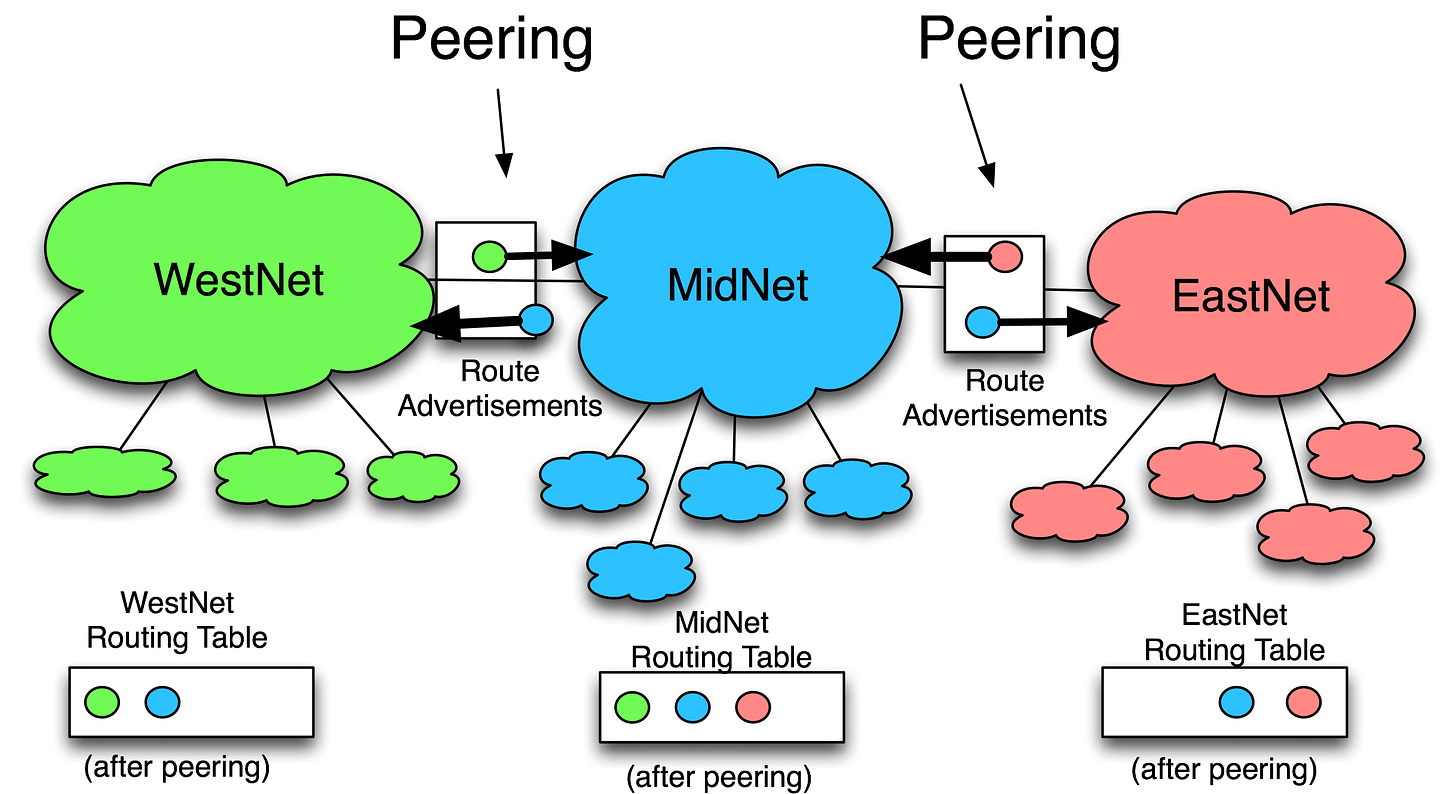

Cloudflare 透過與全球電信商簽訂的「對等互連(Peering)」協議,大幅降低了頻寬成本。

傳統雲端巨頭(如 AWS)必須向全球電信商購買昂貴的跨國骨幹頻寬,並把成本轉嫁給客戶;但 Cloudflare 的機房早就在電信商內部,許多流量可以透過免付費或極低成本的 Peering 傳送。

當然,儲存伺服器、磁碟、電力與維運人力依然是實實在在的成本,R2 並不是「免費」這麼簡單。但因為頻寬這個最貴的變數被壓到極低,Cloudflare 在單位儲存上的總成本,確實比 AWS S3 有結構性優勢。

第二層是商業策略的選擇。

即使把所有成本算進去,Cloudflare 大幅犧牲 Egress 定價,本質上是一種「用短期獲利換長期生態綁定」的進攻姿態。

他們賭的是,只要資料被吸引到 R2,開發者接下來自然會把運算(Workers)、AI 推論(Workers AI)都搬過來。

換句話說,R2 的「零 egress」不完全是成本優勢自然導出的結果,更是一個有意識的戰略武器:用虧損(或微利)的儲存業務,換取開發者生態的入口。

4.3 這是直接挑戰 AWS 嗎?還是不同層級的競爭?

他們並不是完全地競爭。Cloudflare 並沒有打算成為一家「通用型」的雲端巨頭,他們完全無意去取代 AWS 在企業核心 IT 架構中的地位。

如果一家銀行要跑核心的帳務系統,或者企業要訓練龐大的 AI 模型、處理海量的大數據分析(Big Data),他們依然需要 AWS 這樣集中式的巨型運端平台。

Cloudflare 將競爭主戰場鎖定在「邊緣(Edge)」,而非傳統的「核心(Core)」運算。

當開發者發現把圖片、影片、前端應用的資料存在 Cloudflare R2 完全不用過路費時,資料就獲得了自由。

一旦資料自由了,開發者就會把那些「需要極致反應速度、靠近用戶」的任務(例如 Web API、即時互動應用、邊緣 AI 推論),從 AWS 搬到 Cloudflare 的平台上。

Cloudflare 是在告訴開發者:「把重活(大數據分析、核心資料庫)留在 AWS,但把所有跟用戶互動的、需要速度的『前端與邊緣任務』交給我。」

第五章:AI 時代的典範轉移 ── 為什麼 Cloudflare 押注「邊緣」?

隨著 Cloudflare 在 2021 年補齊了儲存與運算的拼圖,它已經變成了一家擁有網絡傳輸,資安,和雲端的一站式平台。

而時間來到 2026 年,這個平台迎來了下一個十年最大的變數,同時也是最大的機會:AI 推論的物理學瓶頸。

在 2023 年 ChatGPT 引爆全球 AI 熱潮時,所有人的目光都集中在同一件事:誰能訓練出最聰明的模型?OpenAI、Anthropic、Google、Meta 競相砸下數百億美元,購買成千上萬張 GPU,在沙漠裡蓋起一座座超級資料中心。

但到了 2026 年,故事變了。

Keep reading with a 7-day free trial

Subscribe to FOMO研究院電子報 to keep reading this post and get 7 days of free access to the full post archives.