下一個瓶頸是CPU?x86還是ARM?誰才是CPU概念股? - 深入分析第43期:AMD,Intel,ARM

在過去數年,整個科技界和華爾街只有一個共同信仰:「得 GPU 者得天下」。

那時候,NVIDIA的 H100 晶片一卡難求,矽谷巨頭們為了搶 GPU,甚至在財報會議上將 GPU 庫存量視為核心競爭力指標。

這段歷史在所有投資人與大眾心裡,植入了一個根深蒂固的常識:AI = GPU。

但在 2026 年的今天,當你走進最先進的 AI 資料中心,你會發現最缺貨、最讓人頭痛的運算瓶頸,已經不再只是 GPU,變成了記憶體,變成了光模塊,變成了電力,變成了散熱。

這些主題都很好,但我們總會忍不住想,還有沒有還未被討論透的機會?

答案是,那個曾經被視為無聊配角的:CPU(中央處理器)。

如果你覺得「CPU 缺貨」聽起來很反直覺,不妨看看最近幾個月產業巨頭們的真實動態:

AMD CEO 蘇姿丰 (Lisa Su) 在近期的財報會議上直言,EPYC 伺服器 CPU 的需求「遠超預期」。在關鍵的資料中心領域,AMD 的高階 CPU 已經面臨嚴重的供不應求,交貨期拉長到 6 個月以上,甚至擁有了 10-15% 的漲價定價權。

曾經陷入低潮的 Intel 發現,自己伺服器 CPU 的庫存竟然在 2025 年底意外見底。公司甚至不得不把原本預留給 PC 產線的晶圓,緊急挪去生產伺服器 CPU 來救火。

最具說服力的,是連「GPU 霸主」NVIDIA 自己的 AI 基礎設施主管都公開承認了一句話:「在擴展 AI 與代理 (Agentic) 工作流時,CPU 正在成為我們的瓶頸。」

在接下來的萬字深度報告中,我們將深度剖析這個 CPU 復興的故事:

頭兩章,我會用最白話的生活比喻,帶你搞懂 CPU 與 GPU 的本質差異,以及 Agentic AI 到底是如何翻轉這一切的。

第 3,4 章,我們將深潛進入硬核的「CPU 架構戰爭」(x86 vs ARM),看清超大規模資料中心裡,到底誰在買單。

第 5 到 7 章,我將為你剖析這場浪潮中的三大受益者:AMD、Intel、ARM Holdings,並給你一份清晰的投資組合定位建議。

讓我們把目光從 GPU 身上暫時移開,來看看 2026 年真正決定 AI 發展速度的那塊晶片。

【寫在前面】

順帶一提,今天探討的這個主題,大概是我寫作至今思緒最流暢、也最得心應手的一篇。這並不是說過去的分析不夠扎實,但這次是寫得最順的,因為所有東西早已在腦中。

至於這份「順暢」究竟從何而來?各位看到文章最後那段「特別後記」時,就會知道答案了。

第一章:CPU vs GPU——一個你必須搞懂的基本區別

如果你不懂 CPU 和 GPU 到底有什麼本質上的不同,後面所有的投資論述與市場板塊推演,對你來說都會像是天書。

在我們深入探討為什麼 2026 年超大規模資料中心(Hyperscalers)都在大規模採購 CPU 之前,我們必須先建立一個基礎認知。大眾普遍的迷思是「AI = GPU,GPU 越強 AI 就越聰明」,但這個觀念在 2026 年已經過時了。

要理解這個轉折,我們得先稍微回顧一下歷史:為什麼過去 40 年是 CPU 稱霸?為什麼過去 10 年 GPU 突然篡位?而現在,為什麼天平又開始向 CPU 傾斜?

1.1 歷史的起點:為什麼過去 40 年,CPU 是無可爭議的王者?

在個人電腦(PC)與早期伺服器的時代,CPU(中央處理器,Central Processing Unit)是整台機器的絕對大腦。無論是 Intel 還是 AMD,他們設計 CPU 的核心哲學只有一個:「通用性」(General-Purpose)。

電腦要處理的事情太雜了。當你打開電腦時,作業系統要載入、滑鼠游標要移動、你要一邊聽 Spotify、一邊打開數十個 Chrome 分頁,同時背景還在下載檔案。

這些任務的特點是:充滿了不確定性與複雜的邏輯判斷。

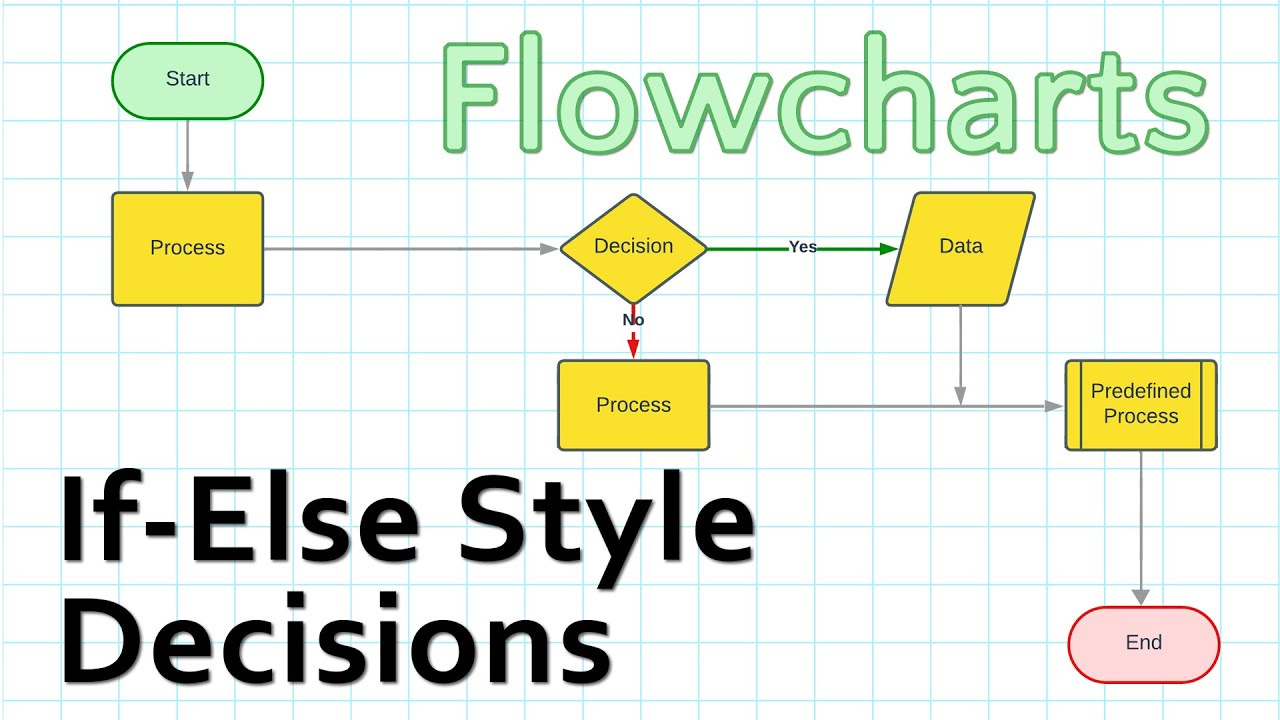

「如果(If)使用者點擊了這個按鈕,就(Then)打開新視窗。」

「如果網路突然斷線,就跳出錯誤提示。」

CPU 就是為這種「如果 A 發生,就去做 B」的複雜邏輯而生的。它就像是一把瑞士刀,什麼都能做,而且切換任務的速度極快。在那個年代,運算能力的瓶頸在於「邏輯處理的速度」,所以 CPU 越快,電腦就越順。

1.2 命運的轉折:為什麼 GPU 成為了 AI 時代的霸主?

GPU(圖形處理器,Graphics Processing Unit)一開始根本不是為了 AI 發明的,它是為了「打電動」而生的。

當你在玩 3D 遊戲時,螢幕上有幾百萬個像素(Pixels),每一個像素的顏色、光影反射,都需要在每一秒鐘內重新計算 60 次。這種計算有一個極大的特點:它非常簡單,但數量龐大,而且每個像素的計算互不干擾。

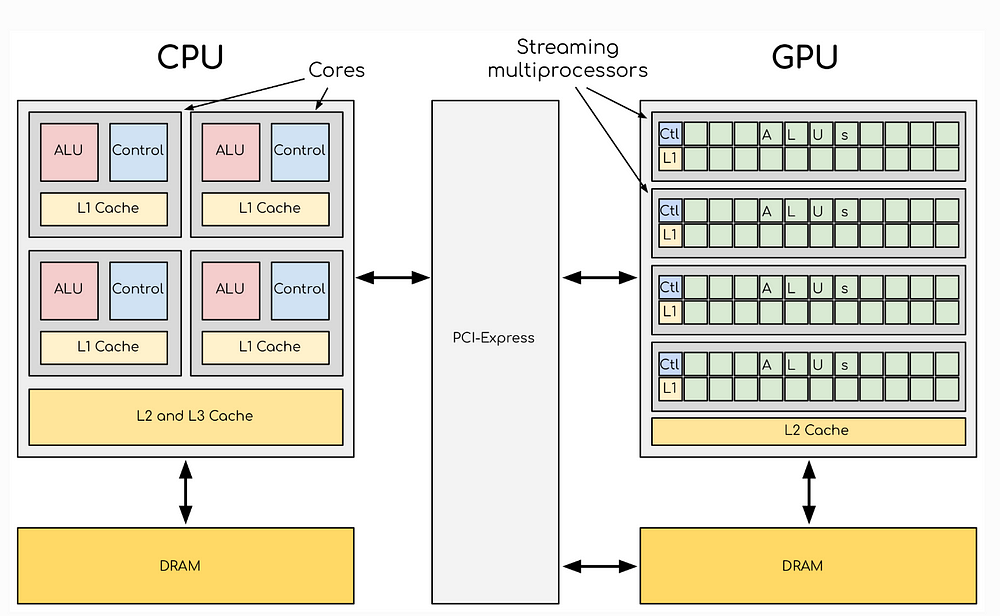

這時候,CPU 這把「瑞士刀」就顯得很笨拙了。你不需要一把精密的瑞士刀去切一萬顆高麗菜,你需要的是一萬把便宜的菜刀同時切。於是,NVIDIA 設計出了 GPU,裡面塞滿了成千上萬個「微小、簡單但能同時工作」的運算核心。

這跟 AI 有什麼關係?

大約在 2012 年左右,科學家們發現了一個驚人的巧合:深度學習(Deep Learning)與神經網路的底層數學,跟打電動畫像素的數學,本質上是一模一樣的!

訓練一個 AI 模型(比如讓它讀完一整座圖書館的書),對電腦來說,就是把文字轉成數字,然後進行幾兆次的「矩陣乘法」(Matrix Multiplication)。這是一種「整齊劃一的算術」。

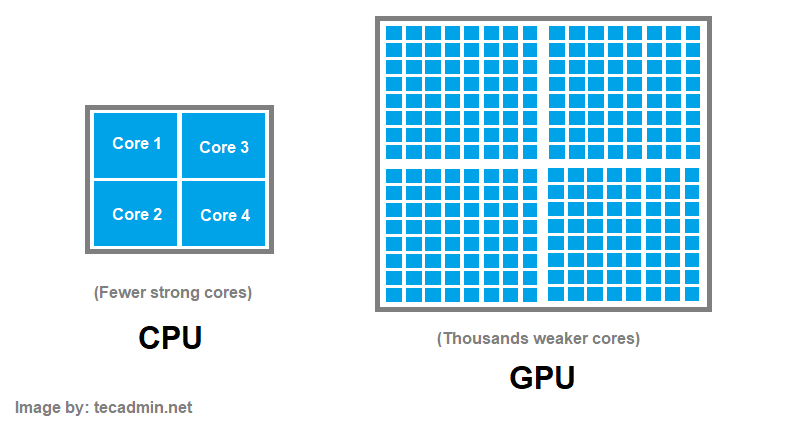

CPU 處理這種海量簡單算術時,會因為核心數太少而塞車。

GPU 處理這種算術時,成千上萬個核心同時啟動,速度是 CPU 的幾十倍甚至上百倍。

這就是為什麼在 2024 年以前的「大模型預訓練時代」,GPU 成為了唯一的霸主。因為當時的 AI 只是在「背書」,而背書的本質就是純粹的平行數學運算。

1.3 核心比喻:一萬名士兵 (GPU) vs 十位大學教授 (CPU)

為了讓後面的投資邏輯更清晰,請你把 CPU 與 GPU 的本質差異,深深印在腦海裡。我們用一個最直觀的比喻來對比兩者:

GPU 就像是一支由一萬名士兵組成的軍隊。

這支軍隊最擅長的是「整齊劃一的算術」(平行處理)。如果你要所有人同時做一樣的簡單動作(例如計算 $1+1=2$),他們可以瞬間完成。

然而,他們的弱點在於遇到突發狀況時的應變能力。一旦邏輯改變,或者需要處理複雜的分支任務,他們就會亂成一團,必須停下來重新整隊。此外,士兵們幾乎沒有「操作工具」的能力,他們天生無法獨立運行一般的軟體或作業系統。

CPU 則像是十位頂尖的大學教授(管理層)。

教授的數量雖然少,但他們極度聰明,最擅長「複雜的決策與邏輯判斷」(序列處理)。他們專門處理「如果...就...」的條件分支,可以瞬間切換策略,善於應對不可預測的亂數任務。

更重要的是,教授們天生就是為了操作各種軟體、網路與資料庫而設計的,他們是系統中真正的指揮官。

1.4 時代的鐘擺:為什麼 AI 發展到了 2026 年,天平開始傾斜?

總結來說,過去十年 AI 的突破,是建立在「把一切問題變成平行數學題」的基礎上,這造就了 GPU 的輝煌。

在那個階段,AI 就像是一個坐在圖書館裡死記硬背的學生,只需要無窮無盡的 GPU 士兵幫忙翻書、做算術。

但到了 2026 年,科技巨頭們發現了一個問題:AI 已經把書背完了,現在它必須站起來,走入現實世界去「做事」。

當 AI 的行為模式從「靜態的文字接龍」轉變為「動態的邏輯推理與工具操作」時,單靠一萬名只會做算術的士兵已經不夠了。系統突然需要大量的大學教授來指揮軍隊、操作軟體、並為 AI 打造複雜的虛擬訓練環境。

GPU 是肌肉,CPU 是神經系統。當肌肉已經練得足夠強大時,現在整個 AI 產業開始需要能指揮這些肌肉的強大 CPU。

第二章:2026 年發生了什麼事?——三股力量同時引爆 CPU 需求

在 2023 到 2024 年,全世界的科技巨頭都在瘋狂搶購 GPU;到了 2025 年,大家開始搶記憶體(HBM)。但時間來到 2026 年的今天,資料中心裡最新的算力瓶頸,很可能會是那個曾經被大家視為配角的 CPU。

為什麼會這樣?因為 AI 的演進在 2026 年跨過了一個分水嶺,三股強大趨勢的同時交匯,前兩股力量發生在 GPU 機架「內部」,而第三股力量則在 GPU 機架「外部」開闢了全新的戰場。

讓我們一一拆解。

2.1 第一股力量:推論時代來臨——AI 的使用量爆炸(Inference Scaling)

這是最容易被大眾忽略,但體量卻最龐大的一股力量。

在 2026 年 3 月的 GTC 大會上,NVIDIA 執行長黃仁勳(Jensen Huang)正式宣告了「推論時代」(Age of Inference)的全面降臨。這意味著 AI 算力的最大消耗口,已經從實驗室裡的「訓練模型」,正式轉向了現實世界中的「服務用戶」。

原因很簡單:訓練一個頂級大模型,可能需要花費幾萬張 GPU 跑上幾個月,這是一次性的工作;但是當這個模型上線後,全球有數億名用戶每天在用它來搜尋資料、寫程式、做醫療診斷與金融分析。這種「推論」的需求是持續不斷、永無止境的。

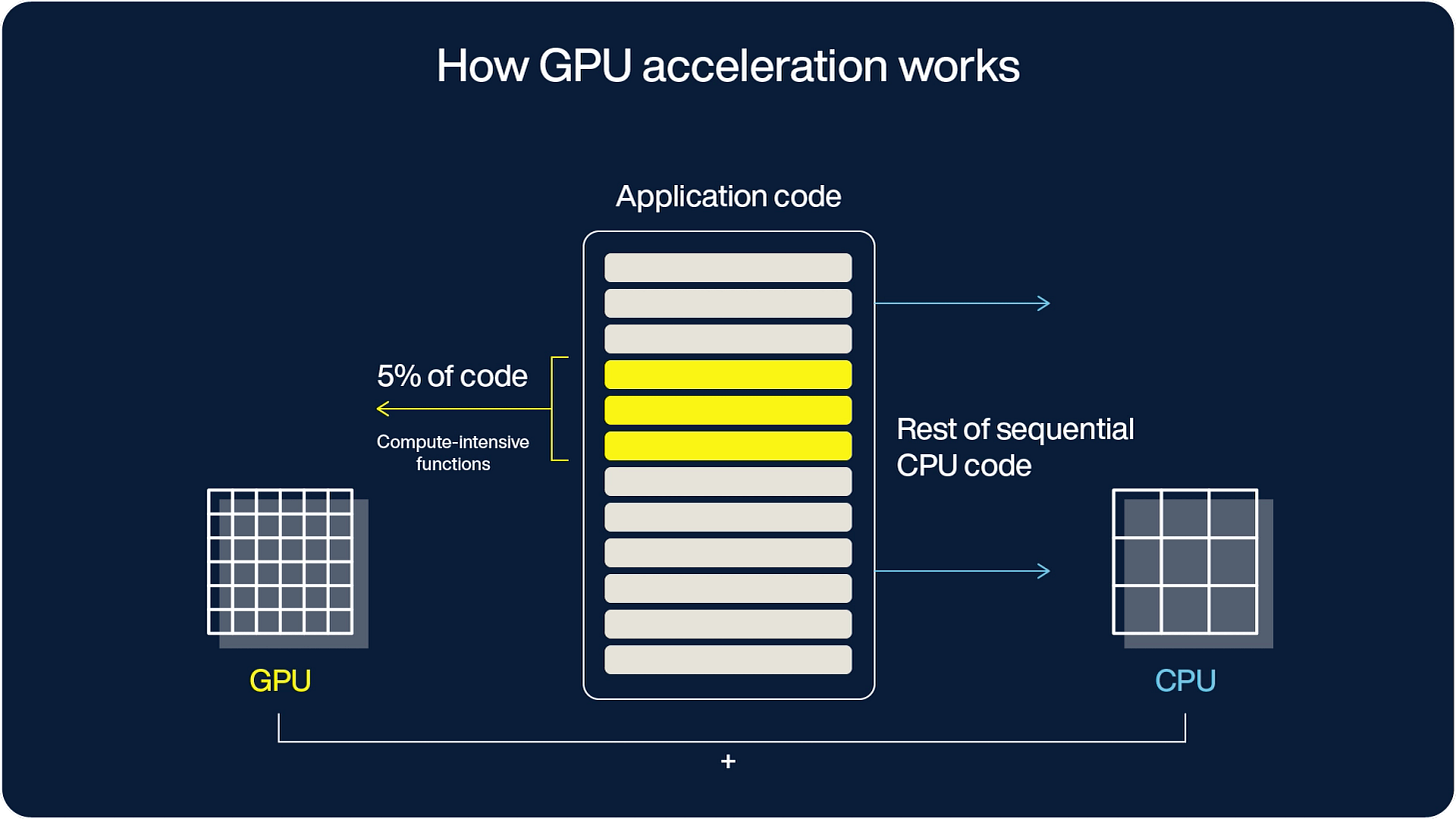

但推論並不等於「只用 GPU」。

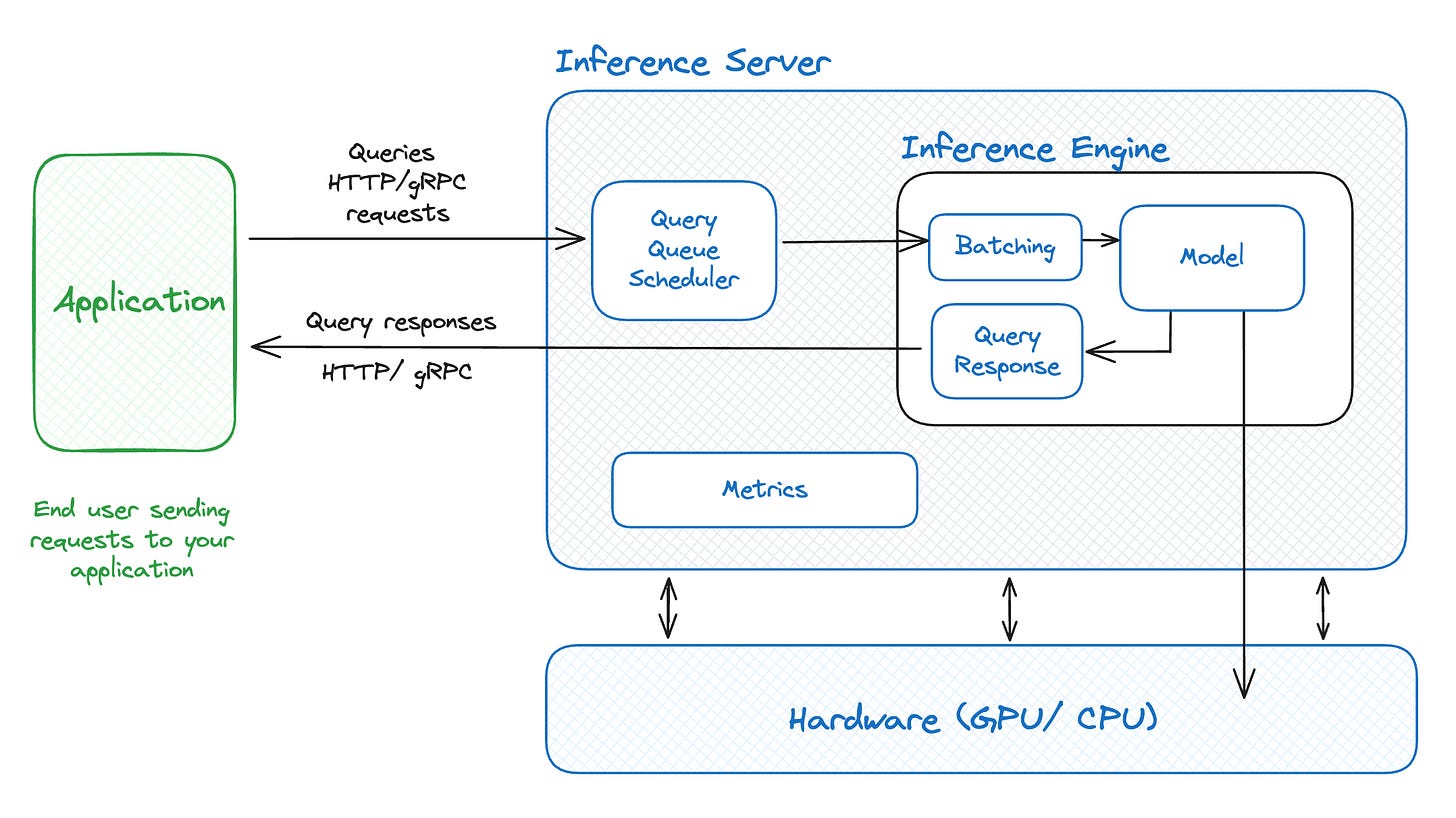

每一次用戶發出請求,都需要 CPU 在前後端做大量繁瑣的「打雜工作」。CPU 必須接收請求、將任務排隊、分批處理、組裝提示詞(Prompt)、進行 Tokenization(把人類的文字切碎成模型看得懂的碎片),最後還要將 GPU 算出來的結果格式化,漂亮地回傳給用戶。

如果說「訓練模型」是花幾個月蓋一座高科技工廠(蓋一次就好),那麼「推論」就是工廠開始 24 小時不間斷地接訂單。

當工廠運轉時,你不能只有負責生產的機器人(GPU),你還需要大量的調度員、包裝員和品管員(CPU)來確保每一張訂單都正確無誤、準時出貨。

當全球 AI 的推論量從「每天幾百萬次」暴增到 2026 年的「每天幾十億次」時,這些 CPU 工作的總量也等比例地呈現指數級爆炸。即使每一次請求的 CPU 工作量沒有增加,光是「訂單量」的暴增,就足以讓 CPU 成為嚴重的瓶頸。

這也是為什麼 AMD 執行長蘇姿丰(Lisa Su)在 2026 年初會明確表示:「我們看到 CPU 需求顯著上升……這是推論需求大幅增長的直接結果。」據多家機構預測,2026 年推論算力佔 AI 總算力的比例將超過 60% 到 70%,而且還在加速攀升。

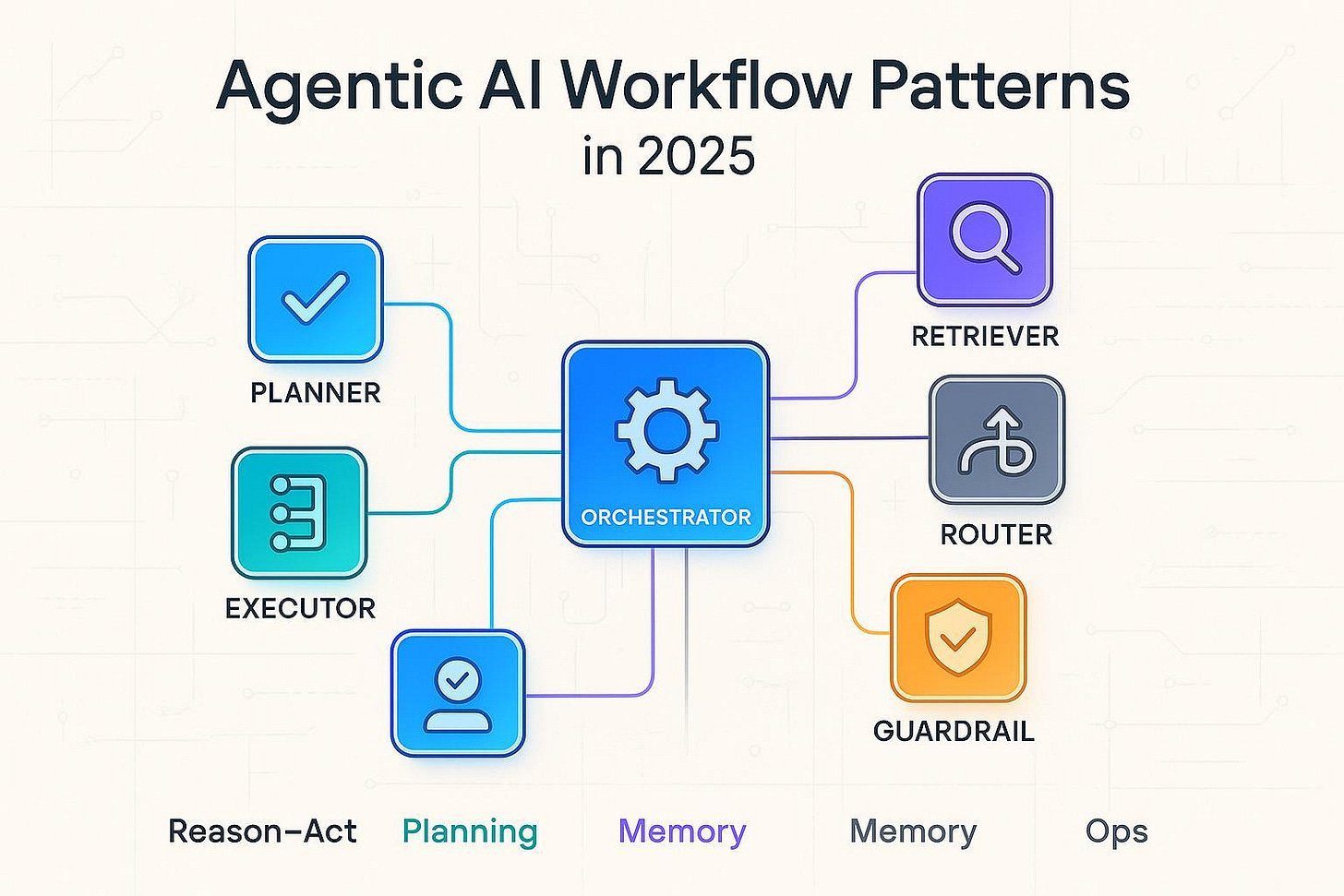

2.2 第二股力量:Agentic AI——每一次請求都變成一個「循環」

如果說第一股力量(推論時代)是「量」的爆炸,那麼第二股力量 Agentic AI(代理型 AI) 就是「質」的翻轉。它讓每一次單一請求的 CPU 工作量,直接暴增了 5 到 10 倍。

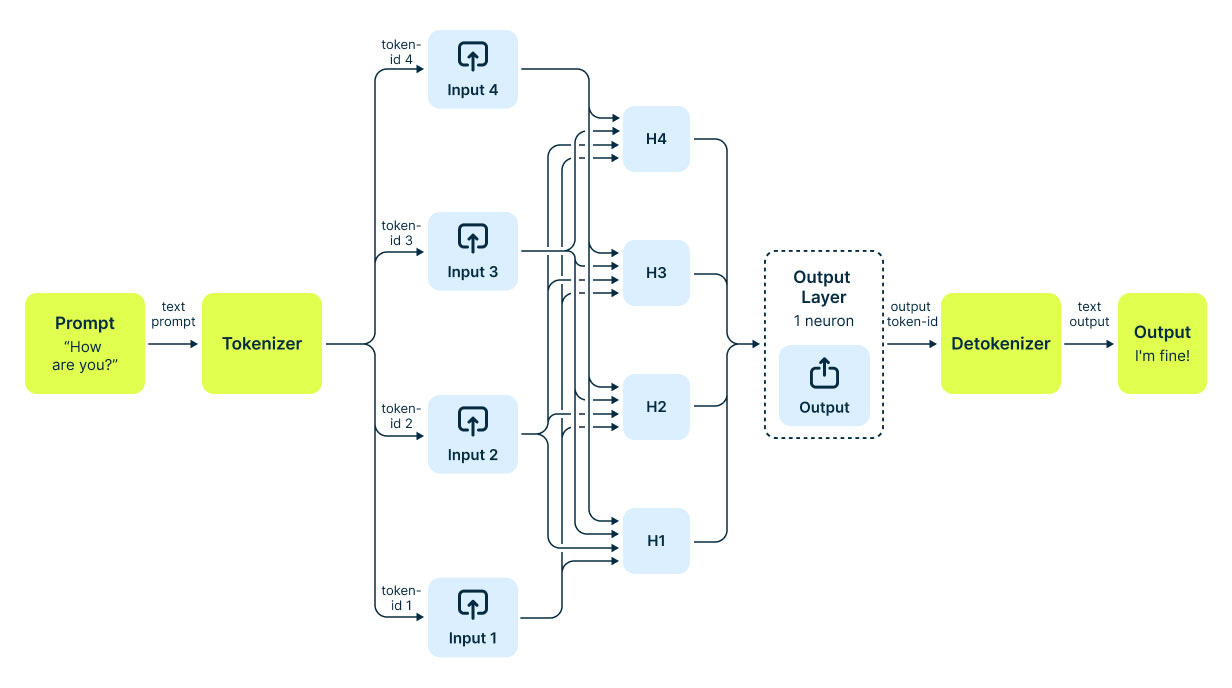

在以前的 ChatGPT 時代,用戶問一個問題,GPU 算一次,然後給出答案。這是一條單向的直線,CPU 只做一點點微不足道的前後處理。

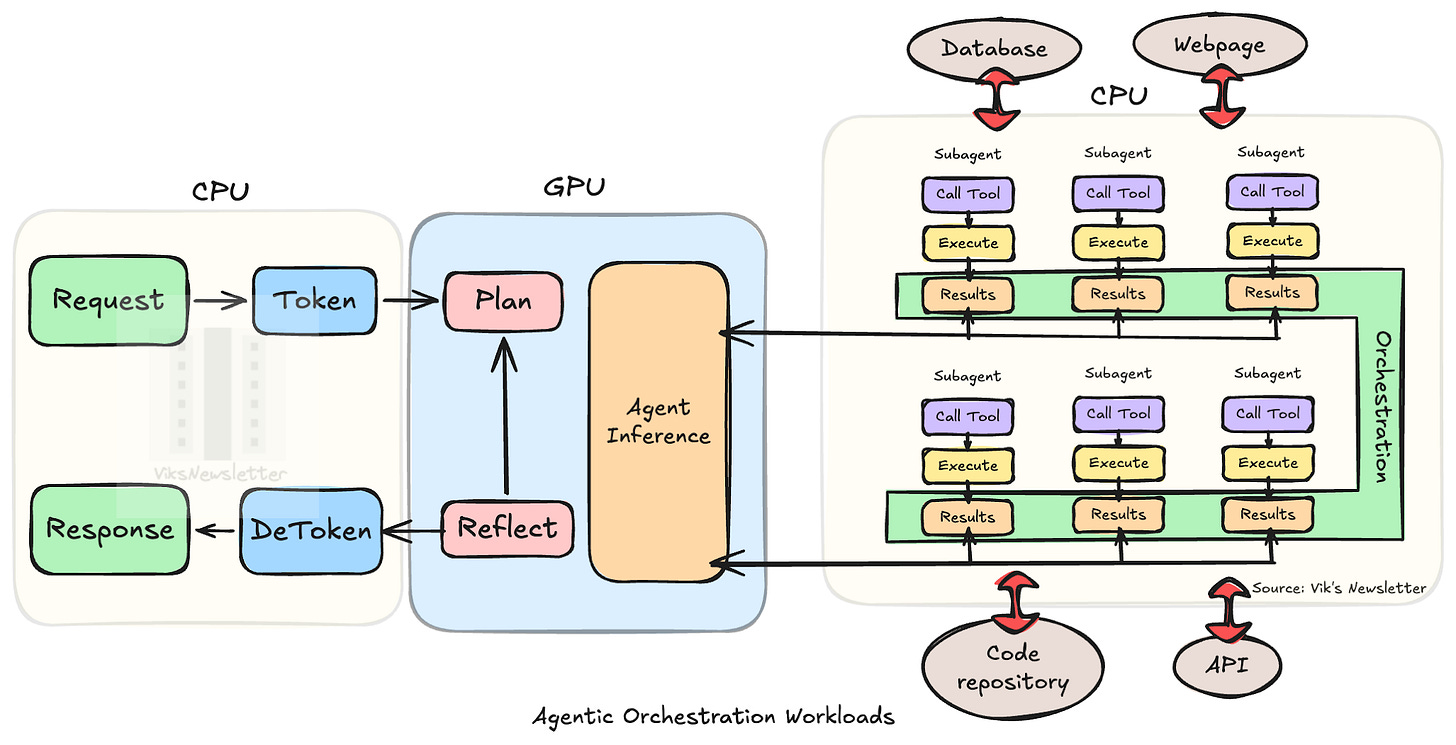

但 2026 年的 Agentic AI 完全不同。當你對 AI 說「幫我規劃下週去東京的行程並訂好機票」時,AI 不會直接給你一段文字,它會自己展開一個多步驟的「循環」(Loop):

規劃步驟(CPU)

打開旅遊網站比價(CPU 呼叫工具)

遇到網站報錯,重新嘗試(CPU 邏輯判斷)

思考下一步(GPU 推理)

填寫表單並驗證(CPU)

在這個複雜的循環裡,GPU 只負責「大腦思考」的那幾毫秒,其餘 50% 到 90% 的延遲與工作量,全部壓在了 CPU 身上。CPU 必須負責呼叫 API、查閱資料庫、執行程式碼、管理記憶狀態。

比喻時間:領班與機器人

以前,每 8 台機器人(GPU)只需要 1 個領班(CPU),因為機器人接到指令就會自己把活幹完。

現在,每台機器人做完一小步,就要回頭問領班:「下一步怎麼做?」、「這個網頁報錯了怎麼辦?」、「幫我打個電話給供應商!」。結果就是,領班忙到崩潰,而昂貴的機器人卻只能在旁邊發呆等指令。

為了解決 GPU 閒置(發呆)的問題,資料中心只能不斷增加 CPU 的數量。這導致了 GPU 機架內部的 CPU:GPU 比例發生了劇變。過去是 1:8,現在飆升到了 1:2 甚至 1:1。以 NVIDIA 最新的 Vera Rubin NVL72 機架為例,裡面塞了 72 顆 GPU,同時也配備了高達 36 顆 CPU。

請記住這個關鍵區分: 推論時代讓「請求變多了」,而 Agentic AI 讓「每個請求的 CPU 工作量變大了」。這兩者是相乘的關係,這就是為什麼 CPU 需求的爆炸遠遠超出了華爾街所有分析師在去年的預測。

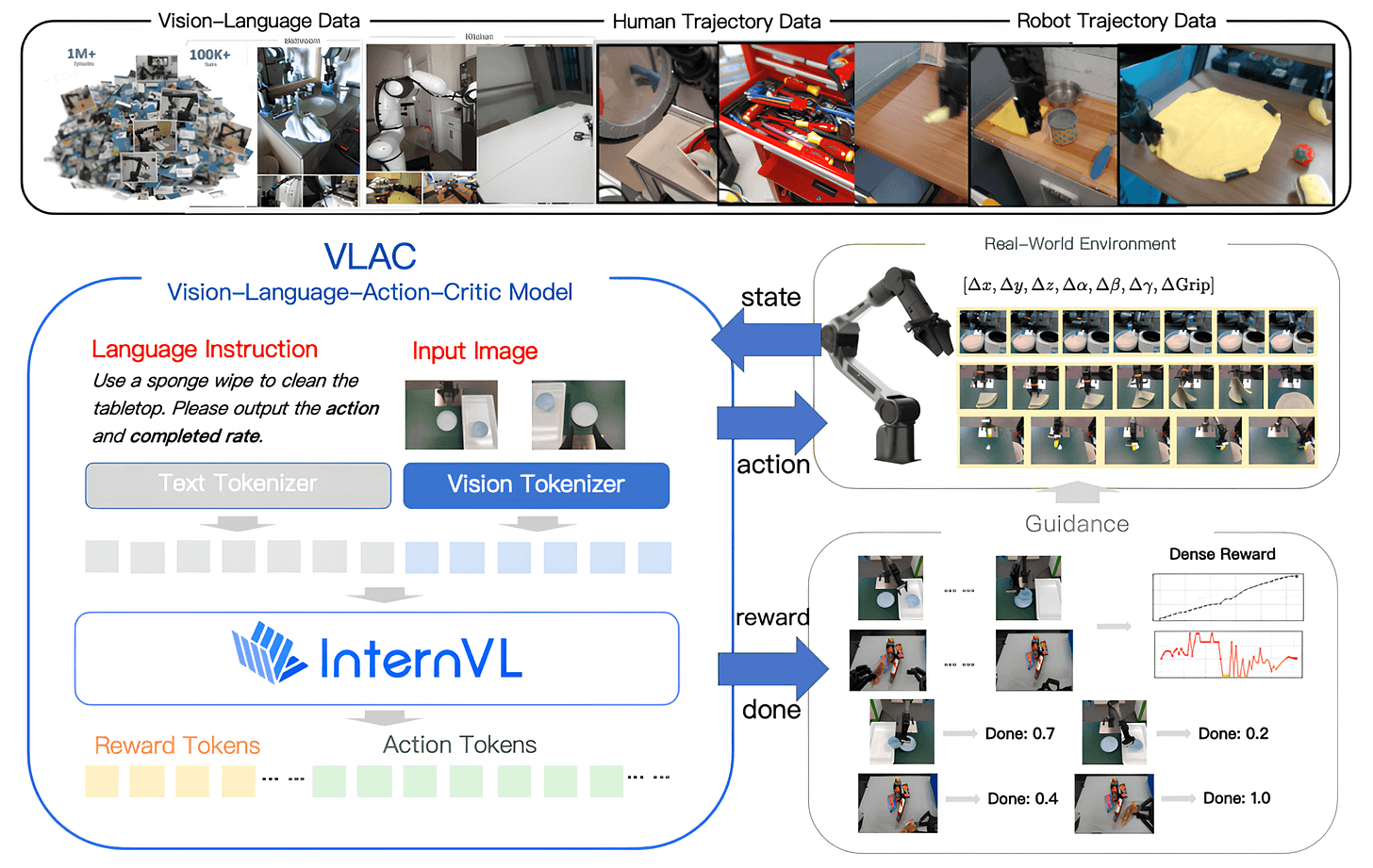

2.3 第三股力量:RL 訓練與合成資料——AI 的「練習場」完全跑在 CPU 上

前兩股力量,都發生在 GPU 機架的「內部」(也就是推論端)。但第三股力量完全不同,它發生在 GPU 機架的「外部」,在那些獨立的、純粹由 CPU 組成的伺服器農場裡。

到了 2025 年底,科技巨頭們遇到了一個瓶頸:網路上人類寫的高品質文章,已經快被 AI 讀光了。現代 AI(尤其是 Agentic 模型)要迎來能力突破,不能再只靠「背書」,它必須靠「自己跟自己練習」。這就是強化學習(RL, Reinforcement Learning)與合成資料的崛起。

從「讀圖書館」到「動手做」

以前的訓練(預訓練),像是讓 AI 坐在那裡「讀完一整座圖書館」。對電腦來說,讀書的本質就是把文字轉成數字,然後做超級大規模的「加法和乘法」。這種純數學任務,完全是 GPU 的天下。

但現在的強化學習,像是教一個學徒修車或幫你訂機票。AI 必須親自「動手」:嘗試點擊按鈕 → 看看有沒有做對(拿分數) → 修正錯誤再試一次。

當 AI 在練習「幫你訂機票」時,我們必須為它蓋一個虛擬的航空公司網站(環境模擬器)。這個網站有選單、有按鈕、有報錯訊息。這是一個標準的「一般軟體」。

在練習的過程中,充滿了「如果...就...(If/Else)」的邏輯爆炸:如果 AI 點錯了按鈕,網站要跳出警告;如果網路斷線,要顯示錯誤代碼。面對這種錯綜複雜的邏輯分支,只會算「1+1=2」的 GPU 跑起來慢得像烏龜,而身為「跑軟體大師」的 CPU 卻如魚得水。

十萬個平行考場的「裁判」

為了讓 AI 變聰明,前沿實驗室不是只開 1 個模擬網站給它,而是同時開 10,000 到 100,000 個平行的虛擬環境。

這 10 萬個虛擬世界,需要龐大的 CPU 核心來擔任「考場管理員」與「裁判」,盯著 AI 練習,然後把「成績單」丟給 GPU,讓 GPU 去更新腦袋裡的數學模型。

運動員與練習場

在 2026 年的新分工裡,GPU 是運動員的「肌肉」,負責最後的思考與發力;而 CPU 是「練習場與教練」,負責打造環境並給予回饋。

以前運動員只需要看比賽錄影帶學習(GPU 讀資料),CPU 需求極低。現在要真的下場跑幾百萬次,沒有足夠的 CPU 蓋出練習場,運動員的能力就停滯不前。

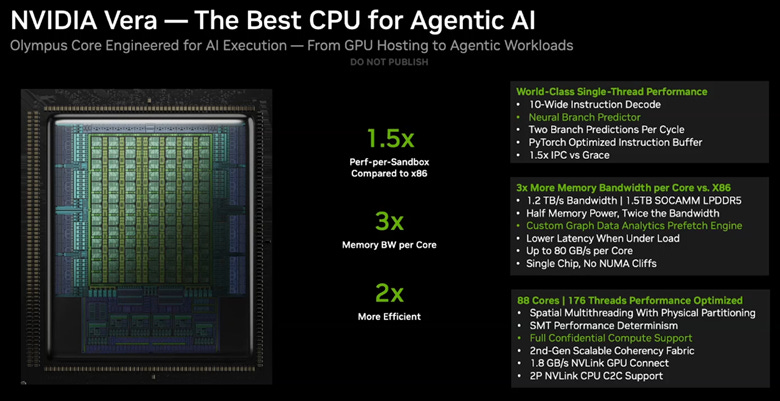

這就是為什麼在 2026 年,OpenAI、xAI、Anthropic 與 Meta 等前沿實驗室,正在不斷搶購數以萬計的純 CPU 伺服器來建構 RL 模擬農場。SemiAnalysis 在 2026 年 2 月的報告中直言:「前沿 AI 實驗室的 CPU 已經不夠用來做 RL 訓練了。」而 NVIDIA 推出的 Vera CPU 機架(一個機架塞滿 256 顆 CPU),就是專門為了同時運行超過 22,500 個並行 RL 環境而誕生的。

小結:

推論數量的指數級增長、Agentic AI 帶來的複雜循環,以及強化學習所需的龐大虛擬練習場——這三股力量在 2026 年完美交匯,將 CPU 從幕後推回了台前。

既然 CPU 變得如此重要,那麼現在市場上的 CPU 霸主們又是如何應戰的?為什麼 NVIDIA 要自己跳下來做 CPU?AMD 的「積木」與 NVIDIA 的「大石頭」到底差在哪裡?

第三章:CPU 架構戰爭——AMD EPYC vs Intel Xeon vs NVIDIA Grace/Vera

當 Agentic AI(代理 AI)和強化學習(RL)把 CPU 重新推回了舞台中心,你可能會問:「那隨便買哪一家的 CPU 不都一樣嗎?」

完全不一樣。

現代資料中心的 CPU,絕對不是「誰時脈比較高、誰就比較快」這麼簡單。AMD 的 EPYC、Intel 的 Xeon,以及 NVIDIA 的 Grace 與新一代 Vera,它們在指令集、物理結構、以及與 GPU 的溝通方式上,有著根本性的哲學分歧。

這三家公司走上了完全不同的科技樹。而這些底層架構的差異,直接決定了誰能吃下哪一塊 AI 基礎設施的超級大餅。這章稍微硬核一點,但我保證會用最白話的方式為你拆解。

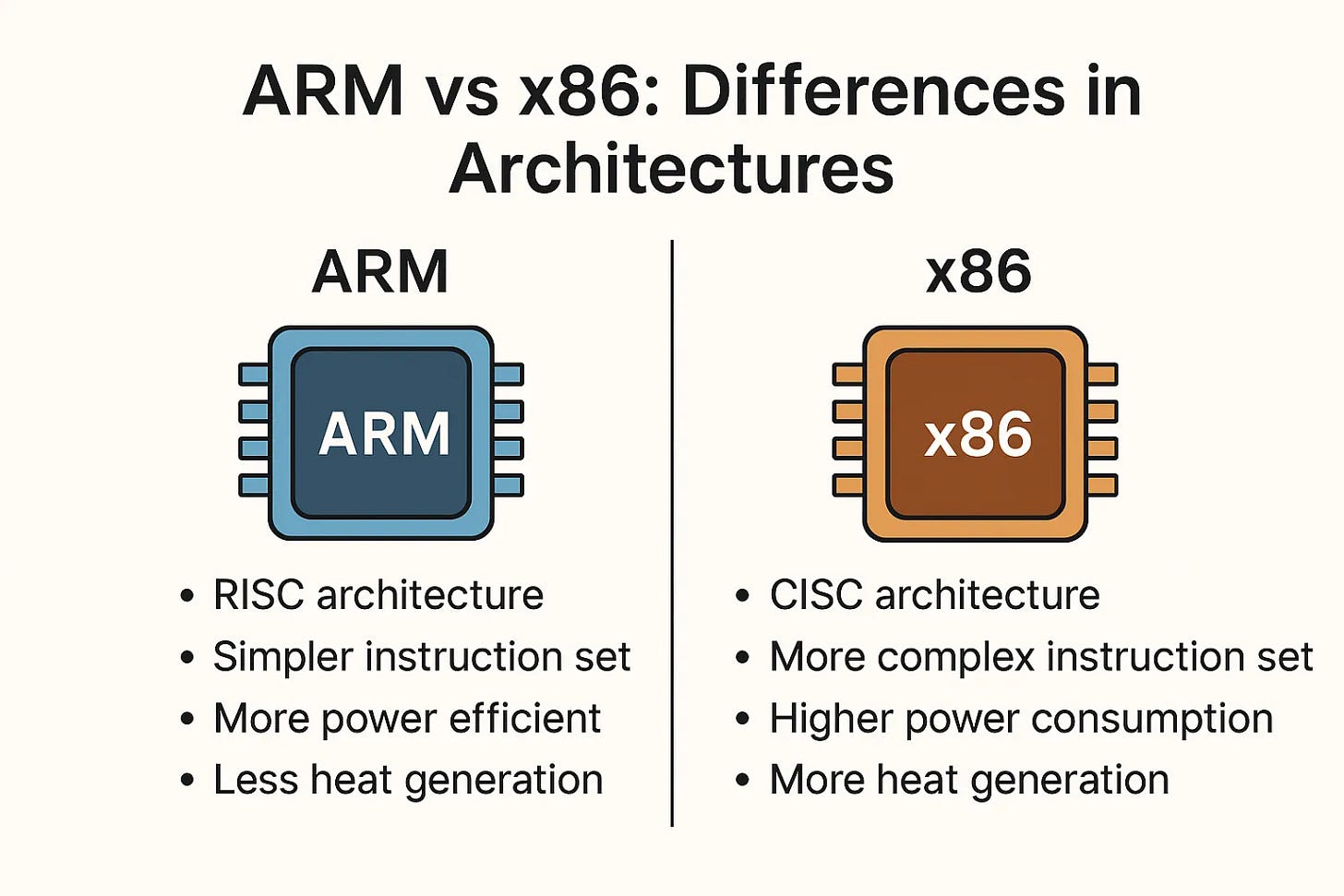

3.1 最大的哲學分裂:x86 vs ARM

要看懂今天的 CPU 戰爭,我們得先稍微回顧一下歷史。這是整個 CPU 世界最古老、也最核心的兩大陣營:x86 與 ARM。

x86(AMD + Intel):統治了 40 年的超級瑞士刀

過去幾十年,只要你打開桌上型電腦、筆電或伺服器,裡面裝的幾乎都是 x86 架構的 CPU(採用複雜指令集 CISC)。你可以把它想像成一把極度強大、什麼工具都有的超級瑞士刀。

它的最大優勢是「無敵的軟體相容性」。全世界過去幾十年寫的企業軟體、資料庫、監控工具,幾乎全部都是為 x86 寫的,丟進去「零修改」就能跑。但代價是,它背負了太多歷史包袱,內部結構複雜,因此比較耗電。

ARM:從「省電小玩具」到「效能怪物」的逆襲

ARM(採用精簡指令集 RISC)的故事完全不同。它一開始是為了手機和各種小型設備發明的。因為手機電池很小,ARM 的設計哲學就是「極致的省電與高效率」。

在很長一段時間裡,科技界有一種刻板印象:ARM 很省電,但效能很弱,只能當玩具,絕對上不了大場面。直到幾年前,蘋果(Apple)把 Mac 電腦裡的 Intel x86 晶片拔掉,換成了自家基於 ARM 架構設計的 M 系列晶片。結果徹底顛覆了市場的既有認知,這顆 ARM 晶片不僅極度省電,效能顯著超越傳統 x86。

這場「蘋果震撼」讓雲端巨頭們醒了過來:原來 ARM 也可以做得很強!

到了 2026 年的今天,ARM 已經正式殺入資料中心。不僅 NVIDIA 的 Grace 和 Vera CPU 是 ARM 架構,連雲端巨頭自己偷偷研發的 CPU(例如 AWS 的 Graviton、Google 的 Axion、微軟的 Cobalt),全部都是基於 ARM 架構設計的。

因為在動輒消耗幾十兆瓦電力的 AI 資料中心裡,ARM 帶來的省電效益實在太香了(在某些 AI 任務中,NVIDIA Vera 的能效是 x86 的 1.5 到 2 倍)。

這對投資市場的意義非常深遠。這意味著 x86 過去 40 年的絕對壟斷已經被打破。雲端巨頭為了省電和降低成本,正瘋狂導入 ARM 架構。這也是為什麼只賣「設計圖」和收版稅的 ARM Holdings,能在這波浪潮中坐享極高的長期結構性紅利;而 AMD 和 Intel 則必須靠著極深的「軟體生態系護城河」與超高核心數來捍衛領土。

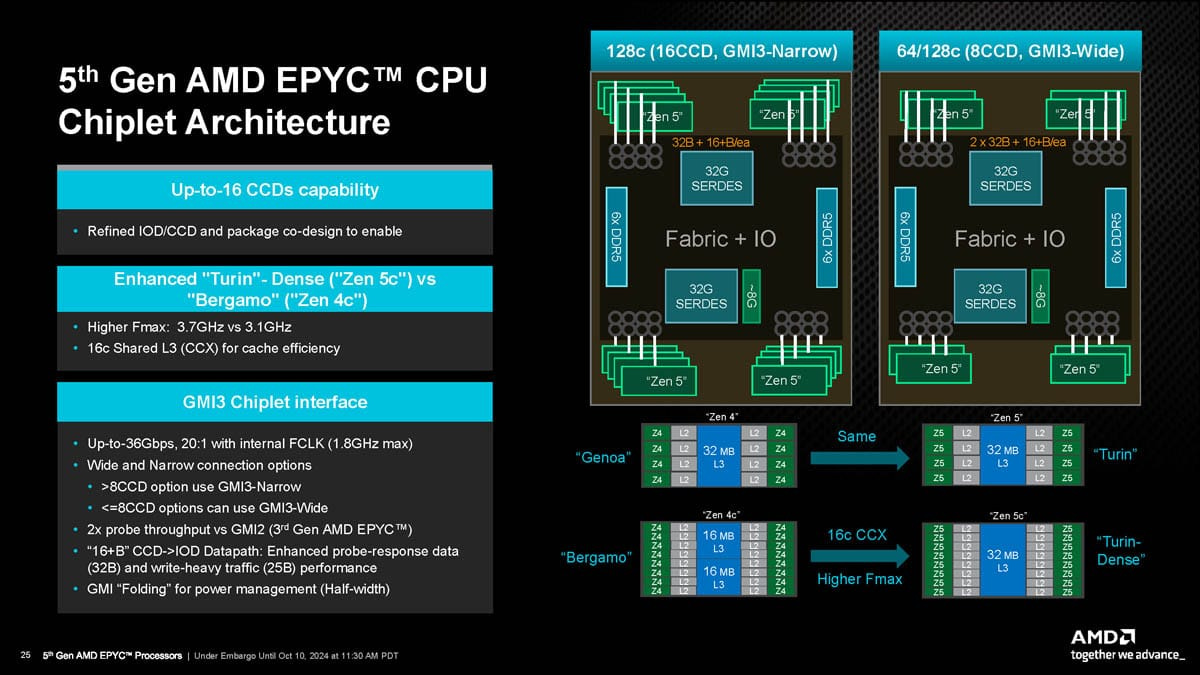

3.2 晶片的物理結構:積木 (Chiplet) vs 大石頭 (Monolithic)

這決定了 CPU 能塞進多少顆「大腦(核心)」,以及它們運作時的流暢度。

AMD 的「樂高積木」(Chiplet 架構)

AMD 的 EPYC(如 2026 年主力的 Turin 與 Venice)採用的是 Chiplet 設計。他們不切一塊超大晶片,而是把 CPU 切成 8 到 16 塊「小晶片(CCD)」,然後像拼樂高一樣,透過中間的 I/O 晶片拼在一起。

優點: 便宜、良率極高,而且核心數可以無限堆疊。這就是為什麼 AMD 能輕易做出 192 核甚至 256 核的超高核心數處理器。對於需要同時開啟 10 萬個虛擬環境的 RL 模擬農場來說,這種「人多好辦事」的架構簡集完美。

缺點: 積木與積木之間溝通,會有微小的延遲(Latency)。

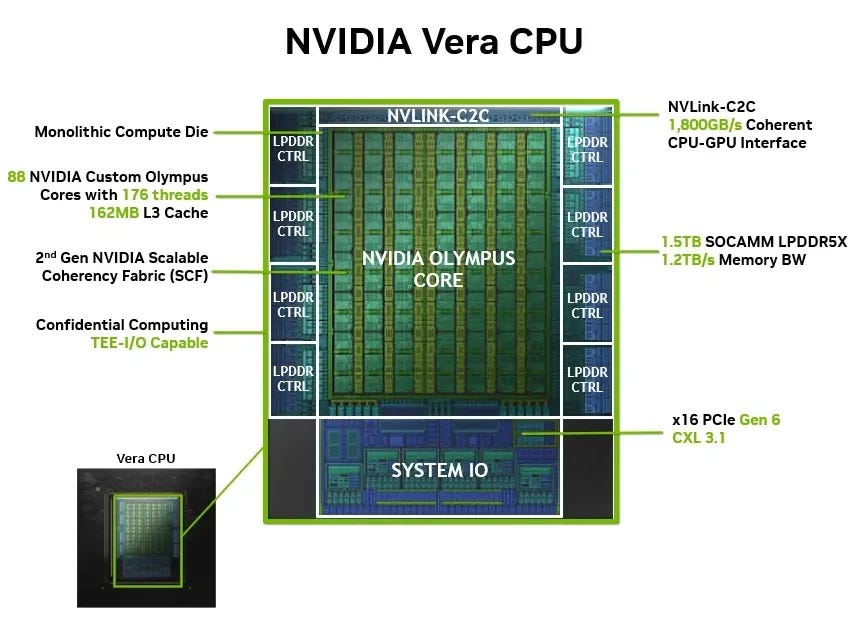

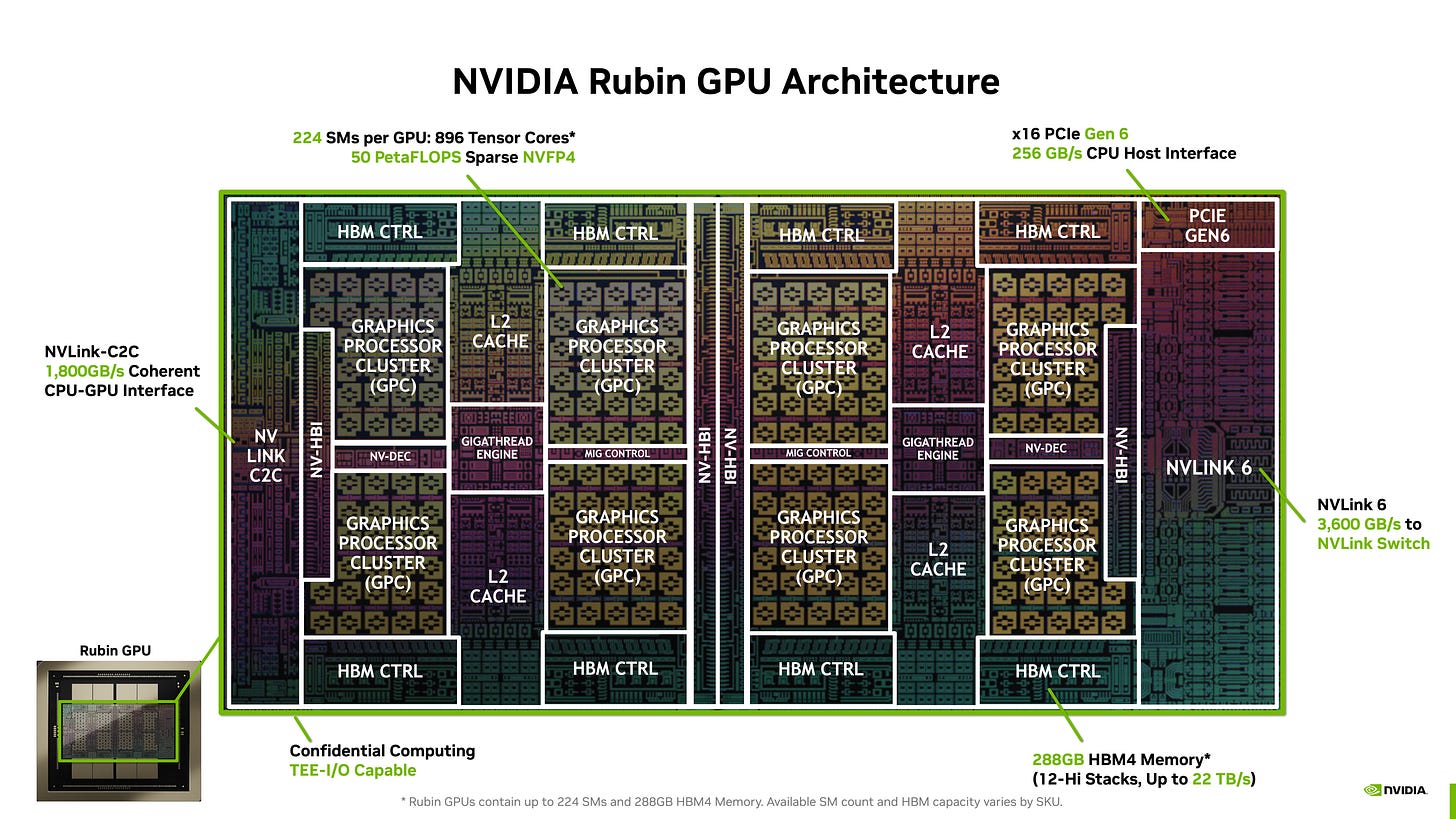

NVIDIA 的「一整塊大石頭」(Monolithic 架構)

NVIDIA 的 Vera CPU 走的是完全相反的路。它是一整塊巨大無比的單一晶片(Monolithic),把 88 個核心全部刻在同一塊矽晶圓上。

優點: 核心與核心之間的溝通幾乎零延遲。在前述的 Agentic 推論循環中,這種超低延遲的均勻網路能讓速度飆到極限。

缺點: 核心數受限(Vera 只有 88 核),且大晶片的製造成本極高。

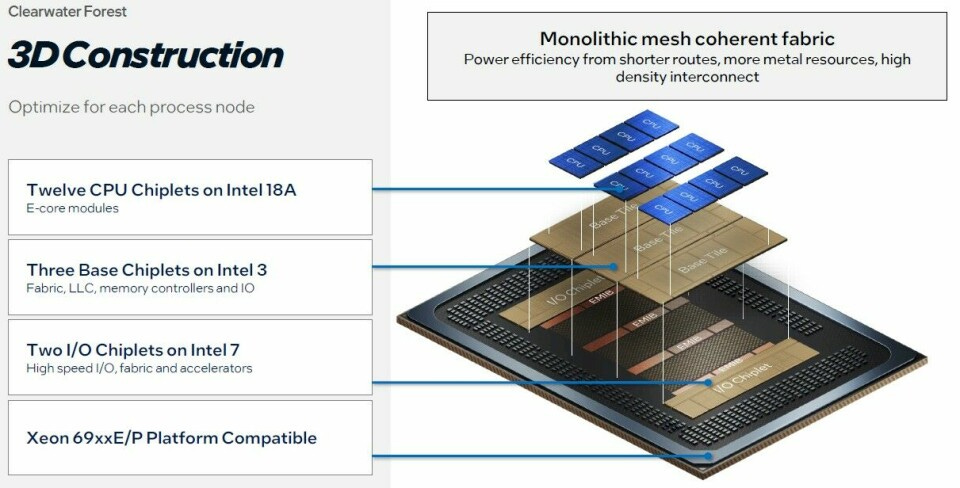

Intel 的「混合微調」(EMIB 封裝)

Intel 的新一代 Xeon(如 Clearwater Forest,高達 288 個 E-core)介於兩者之間。它也是把多塊晶片拼起來,但使用了極度先進的 EMIB 封裝技術,試圖讓這些拼起來的晶片,運作起來感覺像是一塊「大石頭」。技術難度極高,這也是 Intel 翻身的關鍵賭注。

這解釋了為什麼市場不是「贏者全拿」。AMD 的積木架構讓它成為「純 CPU 農場」的絕對霸主,因為那裡需要海量且便宜的核心來做平行模擬;而 NVIDIA 的大石頭架構,則是專注於拿下「GPU 機架內部」那個需要極低延遲的關鍵大腦位置。

3.3 NVIDIA 的獨門武器:NVLink-C2C(技術附錄)

如果只是比核心數跟省電,NVIDIA 其實無法徹底說服客戶買它的 CPU。NVIDIA 真正的關鍵技術壁壘,是一個叫做 NVLink-C2C 的硬體技術。

在傳統的 AMD 或 Intel 伺服器裡,CPU 和 GPU 是兩家獨立的公司,它們之間透過一條叫 PCIe 的「省道」溝通。速度雖然不慢,但當 Agentic AI 需要 CPU 和 GPU 每毫秒都在密集交換資料時,這條省道就塞車了。

NVIDIA 的解法是:把自家的 Vera CPU 和 Rubin GPU 直接綁死在同一塊板子上(稱為 Superchip),並在中間蓋一條「私人高鐵」——NVLink-C2C。

速度輾壓: 到了 2026 年的 Vera/Rubin 世代,這條高鐵的頻寬高達雙向 1.8 TB/s,是傳統 PCIe 的 7 倍以上。

記憶體共享(Cache Coherence): 這是其核心競爭優勢。透過這條高鐵,GPU 可以直接把 CPU 的記憶體當成自己的記憶體來用。AI 模型那些龐大的上下文(KV Cache)可以直接塞在 CPU 便宜又巨大的記憶體裡,GPU 隨用隨拿,完全不需要軟體工程師去寫複雜的搬運程式。

這是 NVIDIA 最深的硬體護城河。只要客戶的 AI 任務需要 CPU 和 GPU 進行極度頻繁的互動(比如最前沿的 Agentic 推論),他們就只能買 NVIDIA 的 Superchip(Vera + GPU)。AMD 和 Intel 在這個特定的「緊密耦合」領域,目前完全無法提供同等級的硬體體驗。

3.4 既然 NVIDIA 這麼強,為什麼雲端巨頭不全部換成 NVIDIA CPU?

看到這裡,你可能會覺得:「那 AMD 和 Intel 怎麼辦!NVIDIA 的 Vera 這麼強,大家全買 NVIDIA 就好了。」

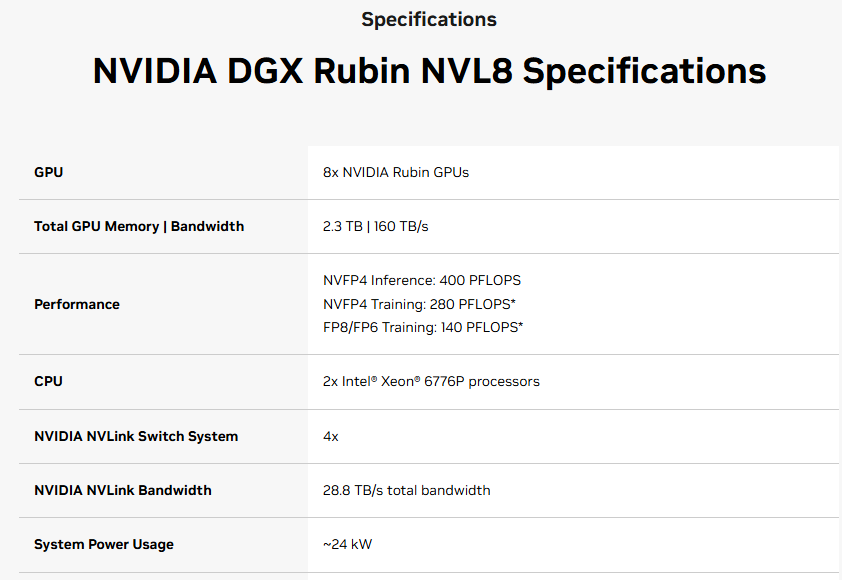

然而實際的部署數據卻呈現截然不同的發展:2026 年,AMD 和 Intel 的伺服器 CPU 賣到大缺貨,連 NVIDIA 自己的旗艦級 AI 伺服器(DGX Rubin NVL8),官方預設搭載的居然是 Intel 的 Xeon x86 CPU!

為什麼會這樣?為什麼超級資料中心不全部換成 NVIDIA 的 ARM CPU?原因有四個:

核心數不夠用: 就像前面說的,RL 模擬農場需要的是「海量平行處理」。AMD EPYC 一顆有 256 核,NVIDIA Vera 只有 88 核。對於那些不需要跟 GPU 緊密綁定的「純 CPU 任務」,買 AMD 划算太多了。

軟體生態系的綁架: 資料中心裡有成千上萬個用 x86 寫的排程軟體、資料庫和資安工具。雲端巨頭(AWS、微軟、Google)不可能為了一個 AI 專案,把整個基礎設施的底層軟體全部重寫成 ARM 版本。

產能與供應量: NVIDIA 的 CPU 產量(受限於台積電的先進封裝產能)遠遠小於 AMD 和 Intel。雲端巨頭動輒需要幾十萬顆 CPU,NVIDIA 根本交不出這麼多貨。

「混合部署」才是最佳解: 雲端巨頭非常聰明,他們把資料中心切成兩半。

最核心的 GPU 訓練/推論機架: 用 NVIDIA 的 Superchip(Vera + GPU),享受極致的 NVLink-C2C 速度。

外圍龐大的 CPU 支援農場: 積極買入 AMD EPYC 和 Intel Xeon,用來跑 RL 模擬、合成資料生成,以及傳統的軟體排程。

這代表着,該市場目前呈現整體規模擴張(TAM 擴大)的趨勢,而非單純的零和博弈。

Agentic AI 創造了兩種完全不同的 CPU 需求:一種是「與 GPU 緊密結合的超快大腦」(NVIDIA 吃下),另一種是「在後勤瘋狂模擬的超級大軍」(AMD/Intel 吃下)。這就是為什麼,儘管 NVIDIA 推出了超強的自研 CPU,AMD 的 EPYC 依然能在 2026 年賣到缺貨並強勢漲價。

到這裡,我們已經建立了一張清晰的架構地圖:NVIDIA 的 Vera 靠 NVLink-C2C 鎖定 GPU 機架內部的「超快大腦」位置;AMD 的 EPYC 靠 Chiplet 的核心數優勢,統治 GPU 機架外部的龐大 CPU 支援農場;Intel 的 Xeon 則憑藉 x86 生態系的深厚根基與七成的裝機量底盤,繼續在傳統企業與混合部署中扮演不可取代的角色。

但架構地圖是靜態的,真正的問題是:這張地圖上的每一塊領土,現在到底有誰在拿著真金白銀去搶?搶的規模有多大?搶的速度有多快?

第四章:誰在買?——超大規模資料中心的 CPU 搶購潮

接下來我們不談理論,直接攤開 2026 年 4 月此時此刻的「進貨單」,看看上一章那三種架構,分別被哪些買家、以什麼樣的規模在部署。你會發現,每一筆訂單背後的選擇邏輯,都精準地對應著我們剛剛拆解過的架構差異。

Keep reading with a 7-day free trial

Subscribe to FOMO研究院電子報 to keep reading this post and get 7 days of free access to the full post archives.