圍攻NVDA霸權,UALink與ESUN的聯盟戰爭是甚麼?ALAB為何躺槍?- 深度分析第16期:NVDA護城河 (上)

如今,每個人都懂得說,NVIDIA是AI時代的終極玩家,擁有極強的護城河。

但是,究竟所謂的「護城河」是什麼?

是那件標誌性的黑色皮衣,是突破天際的市值,還是那塊被譽為AI時代「石油」的GPU?

答案都是,但都只觸及了帝國的冰山一角。

如果NVIDIA的霸權僅建立在最快的GPU晶片上,那這王座並不堅固,畢竟競爭者未必不能設計出更強的晶片。

然而,至今無人能撼動其根基的答案在於:NVIDIA建立的並非孤立的城堡,而是一系列深不見底的護城河所拱衛的龐大帝國系統。而當中有兩項最為突出:

第一道護城河:硬體帝國。

這是一道看得見、摸得著的壁壘。NVIDIA賣的不僅僅是地表最強的引擎(GPU),更是整台預先調校至極限的「冠軍賽車」(DGX系統)。而將數百、數千顆引擎完美協同,讓它們如單一巨獸般思考的,正是其專有的「心電感應系統」——NVLink與InfiniBand。

第二道護城河:軟體靈魂。

這是一道看不見,卻更為致命的壁壘。如果硬體是帝國的軀體,那麼CUDA就是它的靈魂與作業系統。過去十五年,全世界的AI開發者都在這個系統上撰寫程式、建立模型、開創未來。它形成了一種巨大的「鎖定效應」,讓轉換平台的成本變得難以想像。

這兩條護城河都極其深廣,一篇文章不可能將兩部分全部為大家分析完畢。

因此,這篇文章是「NVIDIA護城河」分析的上篇。

我們將首先解構那道引發了整個行業「圍城之戰」的第一道護城河——硬體帝國。在這趟旅程中,我們將深入探討以下幾個核心問題:

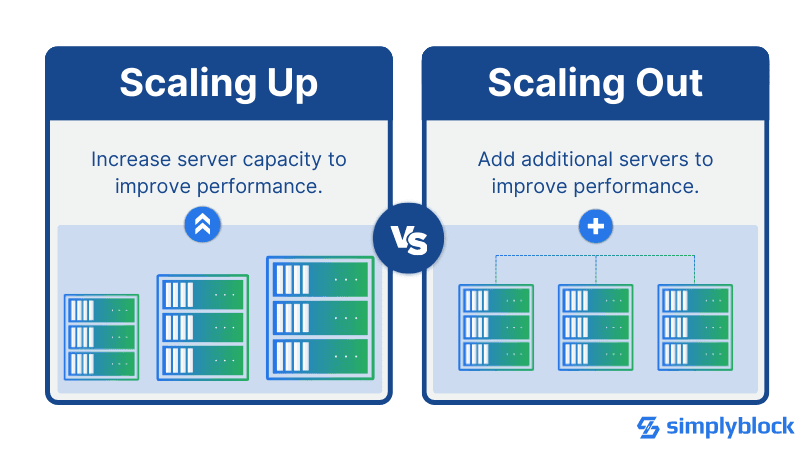

兩種建構哲學: AI超級電腦的兩種建構哲學:Scale-up(向上擴展)與Scale-out(向外擴展)的根本分歧是什麼?

NVIDIA的答案: NVLink與InfiniBand如何作為NVIDIA的「雙重壁壘」,打造出一個封閉但極致高效的硬體帝國?

挑戰者的集結: 「反NVIDIA聯盟」是如何集結的?他們試圖用來攻城的武器——Ultra Accelerator Link (UALink)——又是什麼?

聯盟的內戰: 為何更務實的「乙太網路方案 (ESUN)」會半路殺出,與理想主義的UALink形成直接對抗?

意外的傷者: 在這場聯盟內戰中,Astera Labs (ALAB)為何會成為最尷尬的角色?

終局的預判: 在這場「開放標準」的內戰中,誰是真正的贏家?以及為何這場戰爭的最終結果,可能依然是鞏固了NVIDIA的王座?

然後在下星期的「下篇」中,我們將會深入分析,為何CUDA是NVIDIA最深的護城河。

第一章:互連的飢餓遊戲——Scale-up與Scale-out的宿命對決

如今,AI這頭猛獸的飢餓感,正從對「純粹算力」的渴求,轉向對「高效連接」的極度依賴。

簡單來說,一塊GPU再強,也需要將成千上萬的GPU連在一起共同工作。這引出了一個根本性的問題:當我們擁有了地表最強的F1賽車引擎(GPU),卻要讓它跑在崎嶇的鄉間小路上,會發生什麼?

答案是災難性的。引擎的轟鳴只會化為無謂的噪音,強大的動力將在擁堵與延遲中消磨殆盡。AI革命的真正瓶頸,已悄然從「晶片運算的速度」,轉向了「晶片之間通訊的頻寬」。

一台頂尖的AI伺服器,就是一輛終極F1賽車。

它體內裝載著8個、甚至16個頂級GPU,每個都如同一顆小型核融合反應爐。要讓這些猛獸般的能量核心協同作戰,需要的絕非普通道路,而是一條能夠承受極致速度、擁有超大頻寬、且專為它們設計的「神經傳導賽道」。

究竟如何建立這條「AI高速公路」?有兩種哲學。

向上擴展 (Scale-up):鑄造單一的超級英雄

向上擴展的哲學,是將一台伺服器打造成一位「超人」。

它的目標是將盡可能多的GPU(力量核心)整合進一個單一機箱(軀體)內,並讓它們像一個統一的大腦般思考,創造出被稱為「超級節點」(Supernode)的運算巨獸。

成功的關鍵,在於軀體內部的「中樞神經系統」。這個系統必須快到讓每個GPU都能直接讀寫另一個GPU的記憶體,就像左手能瞬間感知到右手的觸覺一樣,這就是所謂的「記憶體語意(Memory Semantics)」。

相反,如果大腦傳遞給手臂的訊號慢了半拍,超人的力量就無從發揮。

Scale-up的終極理想,是將8個獨立的GPU,融合成一個擁有8倍力量、統一的「超級GPU」。

橫向擴展 (Scale-out):組建一支復仇者聯盟

橫向擴展的哲學,則更像是組建一支「復仇者聯盟」。當單個超級英雄的力量不足以應對末日級的任務時,我們需要的是一支由眾多英雄組成的團隊。

這個策略是將成百上千台獨立的伺服器(超級英雄),透過一個巨大的網路(通訊系統)連接起來,讓他們分工協作,共同禦敵。

我們熟知的Google搜尋、雲端服務等,都是建立在這種架構之上,它依賴的是乙太網路(Ethernet)或InfiniBand這樣的「城際高速公路」。

戰爭的焦點:超級英雄的內部設計圖

當今的AI資料中心正是混合了這兩種哲學:先不計成本地鑄造出無數「超人」級的超級節點(Scale-up),再用高速網路將其連成「超級英雄軍團」(Scale-out)。

然而,當下最激烈的戰爭並非發生在連接英雄的「城際高速公路」上,而是在單一超人的軀體內部。「如何設計超人體內的中樞神經系統」已成為兵家必爭之地。

在這裡,奈秒(nanosecond)級的延遲和TB/s級的頻寬,是決定勝負的唯一標準。

多年來,NVIDIA憑藉其專有的NVLink技術,近乎壟斷了這張「超級英雄設計圖」。

本章小結

瓶頸轉移:AI發展的瓶頸已從單純的晶片算力,轉向了大規模GPU之間的高效通訊頻寬。

兩種哲學:構建AI超級電腦存在兩種核心思路:Scale-up(向上擴展,將單一伺服器打造成極致強大的「超級節點」)與Scale-out(向外擴展,用網路連接成千上萬的伺服器)。

戰爭焦點:當前行業競爭最激烈的戰場,在於Scale-up的內部設計,即如何讓一個機箱內的8個或16個GPU像「單一大腦」般協同工作。

投票時刻:選出下星期你最想看到的主題

在進入下一章之前,付費會員們可以先進行下星期主題的投票。上兩次放在最後投票率不高,這次試試放在較前的位置看看。

投票將在 3天後 結束。

現在,輪到你了。請投下你神聖的一票!

第二章:從單一引擎到多腦神經網絡:NVLink與NVSwitch的共生進化

當我們在新聞上看到NVIDIA發布像B200這樣的「超級晶片」時,很多人會以為它就是一塊巨大、單一的晶片。但這個想法,其實只說對了一半。

與其說它是一塊晶片,不如把它想像成一整套預先組裝好、調校到極致的「冠軍賽車的動力心臟」。NVIDIA賣給客戶的,從來不是單獨的引擎零件,而是這套能直接放上賽道奪冠的「動力總成」。

現在,就讓我們打開發動機蓋,看看這個「動力心臟」裡到底有哪些神奇的零件,以及它們如何從「單打獨鬥」走向「集體作戰」。

第一層:單一「動力心臟」的內部構造

這是一顆引擎本身的核心設計,決定了它能爆發多大的基礎馬力。

CUDA 核心:引擎的「汽缸與活塞」

這是提供最原始運算力的基礎員工,數量成千上萬。就像引擎的汽缸數越多,基礎排氣量越大一樣,它們是所有運算力的根本來源。

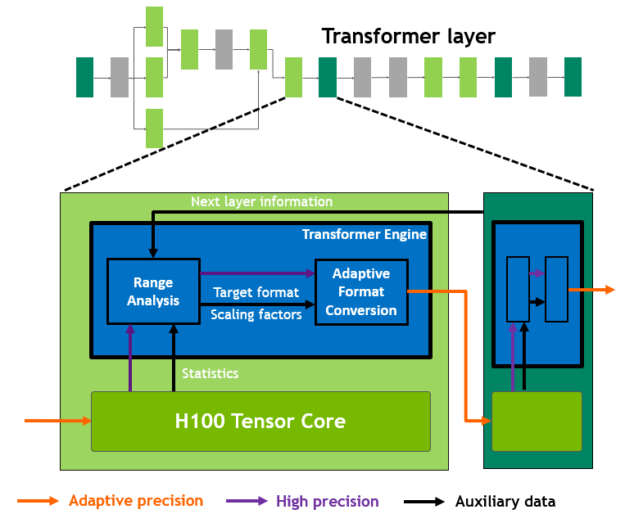

Tensor Core (張量核心):專為 AI 加速的「渦輪增壓器」

這是NVIDIA的王牌。如果說 CUDA 核心是自然進氣引擎,那張量核心就是一顆強大的渦輪。它不處理雜事,只專注於 AI 最核心的數學運算,一旦啟動,就能讓 AI 任務的速度呈倍數飆升。

Transformer 引擎:渦輪增壓的「智慧控制器」

光有渦輪還不夠,還需要聰明地使用它。這個引擎就像一個智慧電腦,它會判斷路況(計算任務),然後精準控制渦輪何時該用「高辛烷值」的精確模式,何時可以切換到「省油」的效率模式,在不影響結果的前提下,把速度和效能發揮到極致。

HBM (高頻寬記憶體):緊貼引擎的「超高速燃料泵浦系統」

再強的引擎,如果燃料跟不上也是白搭。HBM 並不是引擎本身的一部分,而是由數個記憶體晶片堆疊起來,像「燃料塊」一樣,被「黏」在引擎本體的正隔壁。它們之間有數千條私密的超高速通道,確保海量的 AI 資料(燃料)能被瞬間灌入引擎,讓渦輪全速運轉不空轉。

第二層:從「單一引擎」到「冠軍車隊」的鴻溝

到這裡,我們有一顆極其強大的「動力心臟」。但面對訓練現在的史詩級 AI 模型,一顆引擎的力量是遠遠不夠的。你需要一個由 8 顆、16 顆甚至更多引擎組成的「超級引擎矩陣」。

這時,最大的難題出現了:如何讓這 8 顆引擎像「一顆」引擎那樣完美無瑕地協同工作?

要理解NVIDIA的答案有多麼革命性,我們必須先看看傳統的方式——這也是其他競爭對手(以及過去的NVIDIA)所依賴的方式。

傳統方式 vs. NVIDIA之道:公共道路 (PCIe) vs. 私人高速 (NVLink)

傳統方式:走走停停的「公共道路系統」(PCIe)

比喻: PCIe(Peripheral Component Interconnect Express)就像城市裡的公共道路。它用途廣泛,必須服務所有人——顯示卡、網卡、硬碟……所有設備的數據都在上面跑。

數據路徑: 當兩顆 GPU 需要透過 PCIe 溝通時,數據的路徑通常是:GPU 1 → CPU → GPU 2。CPU 在這個過程中扮演了「交通警察兼轉運站」的角色。數據必須先繞道進入 CPU,再由 CPU 轉發給另一顆 GPU。

問題所在: 這條路徑不僅繞遠路,且CPU這個「轉運站」本身就是巨大瓶頸,其處理速度遠跟不上GPU龐大的數據交換需求。這就像讓F1賽車手用郵局信件溝通戰術,緩慢且低效。以當時最先進的PCIe 5.0為例,其約128 GB/s的雙向頻寬,在GPU世界裡是「塞車」等級的速度。

NVIDIA之道:具備「心電感應」的私人高速公路與中央交通樞紐

第一步:建造「私人高速公路」(NVLink)

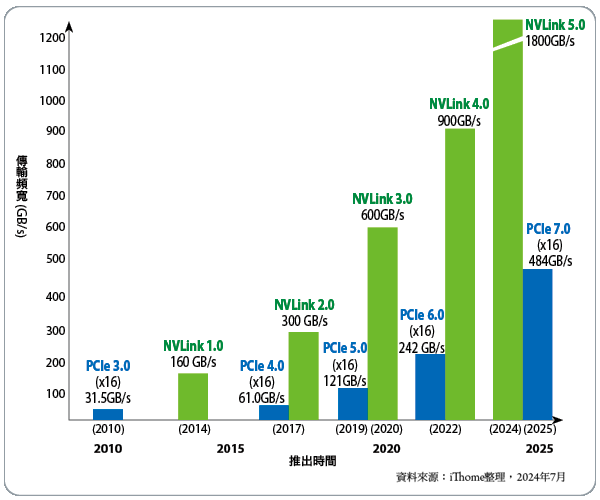

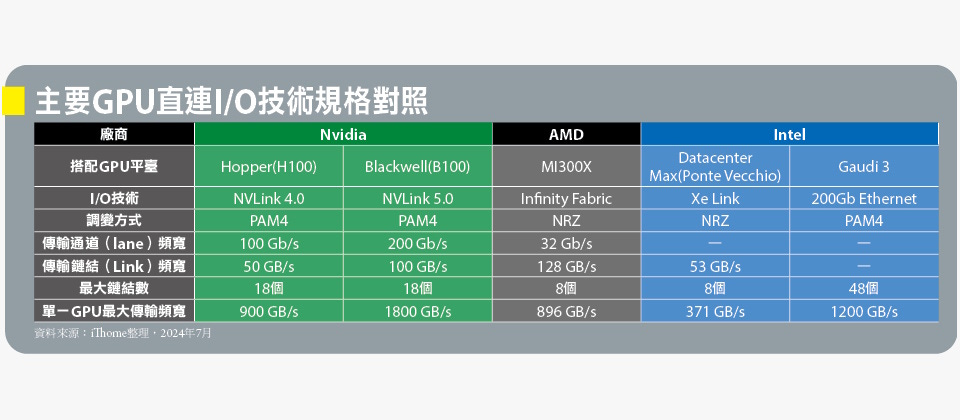

比喻: NVLink 是NVIDIA為自家 GPU 車隊修建的專屬、私密、點對點的超級高速公路。數據可以直接在 GPU 1 ↔ GPU 2 之間傳輸,完全繞過了 CPU 這個「慢速轉運站」。它實現了賽車隊夢寐以求的「心電感應」。以 Hopper 架構的 NVLink 4.0 為例,它提供了 900 GB/s 的總頻寬,是 PCIe 5.0 的 7 倍之多。

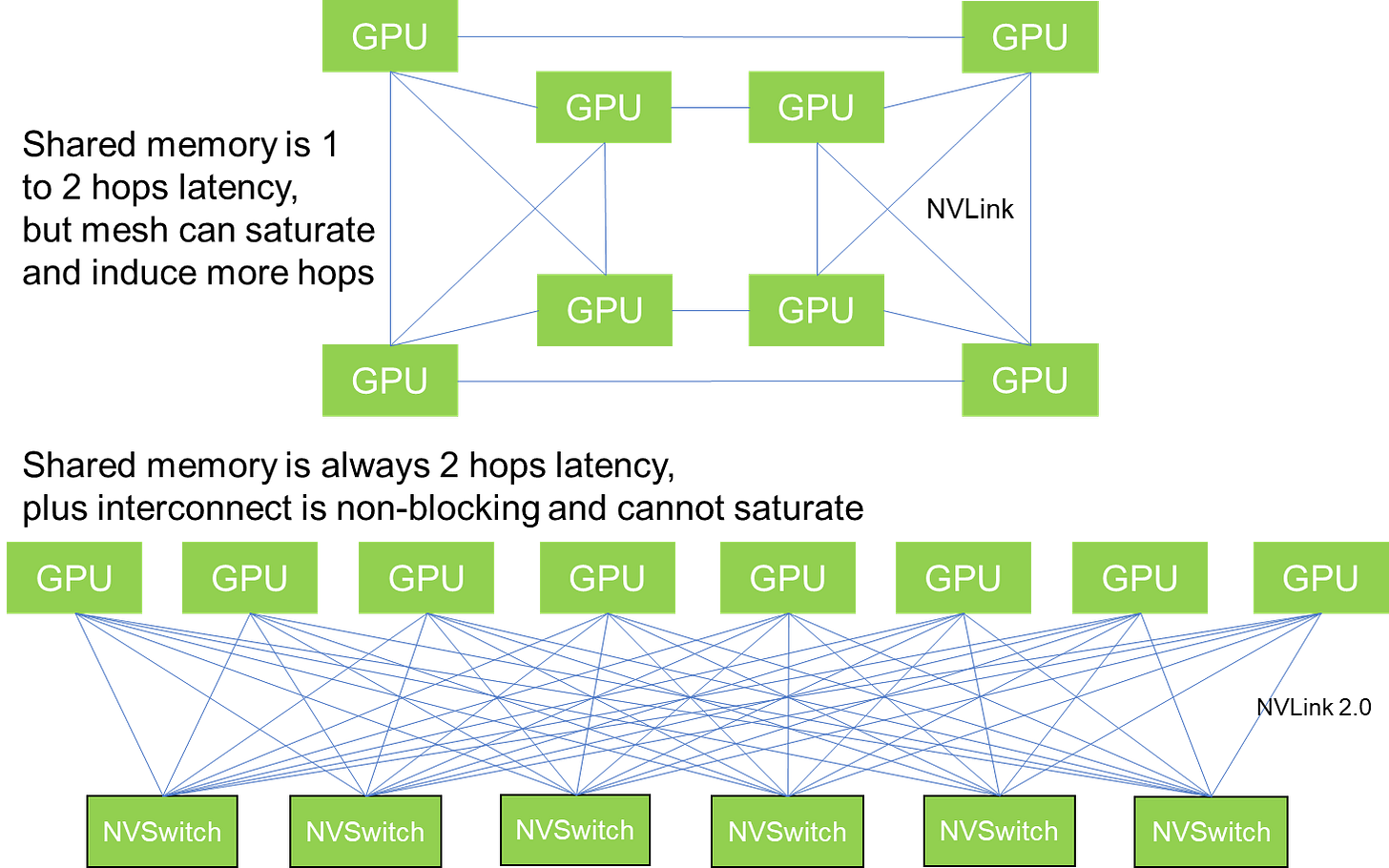

第二步:建造「巨型智慧交通樞紐」(NVSwitch)

問題浮現: NVLink 完美解決了兩顆 GPU 的通訊,但如果我們有 8 顆、16 顆 GPU 呢?如果要在每兩顆 GPU 之間都修建一條 NVLink 私人高速,那整個系統將被錯綜複雜的交流道塞滿,成本和複雜度將呈指數級增長。

NVIDIA的終極答案: NVSwitch 就此登場。它就像是在所有 8 條或 16 條私人高速公路的中心,建造了一個巨大無比、極其智慧的「圓環交通樞紐」。

工作原理: 每一顆 GPU 都用自己的 NVLink 高速公路連接到這個中央樞紐上。當 GPU 1 想與 GPU 7 通訊時,NVSwitch 會瞬間為它們建立一條暢通無阻的臨時專線,同時還能讓 GPU 3 和 GPU 5 進行全速通訊,彼此絕不干擾。

壓倒性優勢: NVSwitch 讓一個機箱內的所有 GPU 形成了一個「全互聯」的超級節點。任何一顆 GPU 都可以用 NVLink 的完整速度與任何另一顆 GPU 進行通訊,就像它們都彼此相鄰一樣。這讓 8 顆 GPU 真正化身為一個由 8 顆引擎驅動的、思想統一的巨大戰爭機器。

第三層:護城河的深度 — NVIDIA的交通建設到底領先多少?

剛剛我們用比喻解釋了NVIDIA的「私人高速公路 (NVLink)」和「智慧交通樞紐 (NVSwitch)」。現在,讓我們用冰冷的數字來衡量,這套系統到底有多麼不可思議,以及它如何構成了NVIDIA最深的一道硬體護城河。

與「公共國道 (PCIe)」的比較:不是更快,是不同次元

NVIDIA最新的第五代 NVLink,其雙向總頻寬高達 1.8 TB/s。這是什麼概念?它比當前最快的公共國道 PCIe 5.0 (128 GB/s) 整整快了 14 倍。這不是 F1 賽車和普通轎車的區別,這是 F1 賽車和自行車的區別。

與競爭對手的「私家橋 (如 AMD Infinity Fabric)」比較:規模的絕對壓制

競爭對手也意識到問題,開始建造自己的私家橋。以 AMD 的 Infinity Fabric 為例,其在不同 GPU 封裝之間的互連頻寬最高僅約 100-200 GB/s。這與 NVLink 5.0 的 1.8 TB/s 相比,存在著數量級的差距。

但更致命的是「規模」。由於缺乏像 NVSwitch 這樣的「巨型交通樞紐」,AMD 的系統最多只能有效連接 8 座工廠(GPU)。而NVIDIA的 NVL72 系統,可以將 72 顆 GPU 視為一個統一的整體。這是 8 vs 72 的系統級差距。

與「開放標準橋樑聯盟 (UALink)」的比較:現實與藍圖的差距

為了對抗NVIDIA的壟斷,AMD、Intel、Google 等公司組成聯盟,計畫打造一套名為 UALink 的「開放式標準橋樑」。

問題是,截至目前,這座「未來之橋」還停留在紙上,連一根橋墩都還沒建起來。而NVIDIA的 NVLink 大橋和 NVSwitch 樞紐已經迭代了五代,在全球成千上萬的資料中心裡穩定運行了近十年。

這就是NVIDIA的致勝關鍵。當競爭對手還在思考如何打造一顆更快的 GPU 引擎時,NVIDIA已經透過 NVLink + NVSwitch 的組合,打造了一個無與倫比的「冠軍車隊協同作戰系統」。

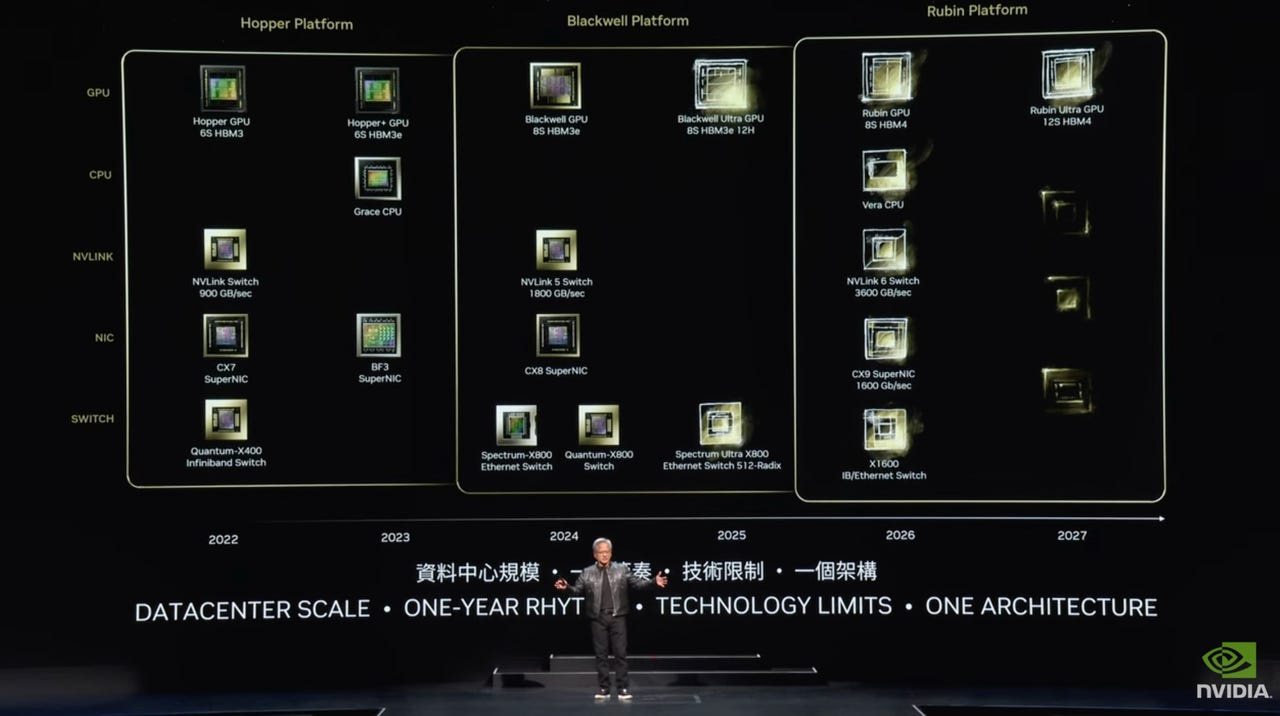

第四層:共生進化的宏偉藍圖 — 從 Hopper 到 Rubin

NVIDIA的設計哲學,是一場「整體進化」。如果只升級了引擎的渦輪(Tensor Core),卻沒有拓寬心電感應的頻寬(NVLink),那麼強大的引擎們就會因為溝通不良而互相等待。

這條「引擎大腦」與「神經系統」同步進化的路徑,清晰地展示了從「單腦冠軍」走向「多腦集合體」的宏偉藍圖。

Hopper 架構 (2022):奠定霸權的「單腦冠軍」

Hopper 是「單晶片設計」的巔峰之作,一顆完美、巨大且強悍的「單一核心大腦」。它與 NVLink 4.0 (900 GB/s) 的結合,首次讓 8 顆 GPU 能以前所未有的效率協同工作,奠定了NVIDIA的絕對霸主地位。

Blackwell 架構 (2024):「雙腦合一」的次世代革命

當「單一大腦」的物理尺寸逼近極限,NVIDIA將兩個頂尖大腦「黏」在一起,創造出「雙晶片」設計的 Blackwell。

對內: 透過一條名為 NV-HBI (NVIDIA High-Bandwidth Interface) 的晶粒內(die-to-die)互連技術,以高達 10 TB/s 的驚人頻寬,將兩顆晶片「縫合」成一個對外統一的「雙腦專家」。這就像連接左右腦的「胼胝體」。

對外: 為了餵飽這個胃口加倍的「雙腦專家」,對外的 NVLink 5.0 頻寬直接翻倍至 1.8 TB/s。這就像為 72 位「雙腦專家」建立了一個「集體心電感應矩陣」,讓他們像一個擁有 144 個腦葉的單一超級大腦一樣運作。

Rubin 架構 (預告 2026) & Rubin Ultra (預告 2027):邁向「多腦」的未來藍圖

Rubin (2026): 延續「雙腦專家」的成功,但引擎更強。與之配套的 NVLink 6.0 頻寬預計將再次翻倍至 3.6 TB/s。

Rubin Ultra (2027): 這是更激進的飛躍,從「雙腦」進化到「四腦(Quad-Chiplet)」。這時,挑戰不再僅僅是頻寬,而是如何指揮一個機櫃內由數百個GPU晶粒所組成的龐大系統協同作戰。

結論:封閉但極致高效的「神經系統」壁壘

從 Hopper 的「單腦冠軍」,到 Blackwell 的「雙腦合一」,再到 Rubin Ultra 的「四腦集合體」,這條清晰的進化路徑揭示了NVIDIA的戰略核心:計算核心的數量和架構(大腦)在演進,指揮它們的神經系統(NVLink)也必須同步進化。這是一個有因有果、充滿邏輯力量的「共生進化」。

NVLink 這套專有的「神經系統」,確保了只有NVIDIA自家的「大腦」才能無縫接入,享受這種極致的互連效率。這道由系統工程、架構設計和前瞻性佈局共同打造的硬體壁壘,構成了NVIDIA帝國最深邃、最堅固的護城河。

本章小結

NVIDIA之道:NVIDIA透過專有的NVLink(GPU間的私人高速公路)和NVSwitch(智慧交通樞紐),徹底解決了傳統PCIe的瓶頸,實現了機箱內GPU的「全互聯」。

壓倒性優勢:NVLink的頻寬是PCIe的十幾倍,NVSwitch的架構更讓NVIDIA系統的擴展規模遠超競爭對手,形成了代際領先。

共生進化:NVIDIA的GPU架構(從Hopper到Blackwell再到Rubin)與NVLink技術同步迭代,形成了一個封閉但極致高效、不斷自我加固的硬體生態。

第三章:向外擴展 (Scale-out) — 編織帝國的神經網絡

用NVLink熔鑄出算力驚人的「單一巨腦」(Scale-up),只是NVIDIA解決方案的第一步。

一座城堡的力量終究有限,當戰爭規模擴大到需要動用上萬顆GPU的帝國級會戰時,一個更宏大的挑戰便浮現出來:如何讓數千座算力城堡高效協同作戰,也就是「橫向擴展 (Scale-out)」。

想像一下,數千座這樣的算力城堡散佈在一個巨大的資料中心裡。如果它們之間只能用傳統的「驛站馬車」(傳統乙太網)來傳遞情报,那麼即使每座城堡裡的軍隊(GPU)再精銳,也無法協同作戰。NVIDIA 比任何人都更早地預見到了這個新的戰場。

當所有人的目光都還聚焦在 GPU 晶片的算力競賽時,黃仁勳悄然落下了一枚看似無關,實則決定全局的棋子。

2019 年,NVIDIA 做出了決策:斥資 69 億美元,收購了在高效能運算 (HPC) 網路領域佔據絕對統治地位的以色列公司——Mellanox。

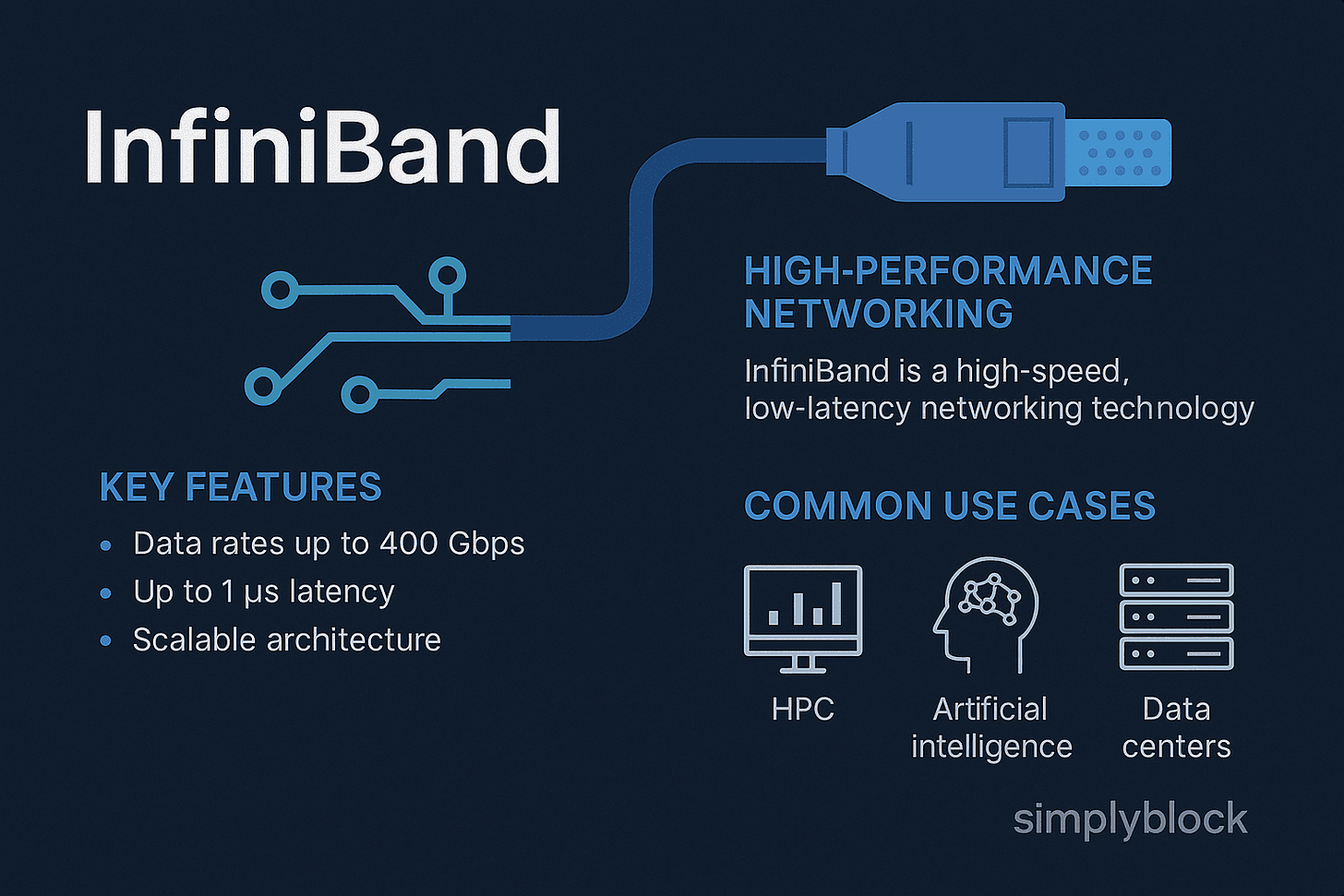

Mellanox 手中握著的,正是編織帝國神經網絡的終極武器:InfiniBand。

InfiniBand 並非普通的網路技術,它從誕生之初就是為超級電腦之間的「心靈溝通」而設計的。與我們日常使用的乙太網相比,它擁有兩大近乎「魔法」的優勢:

超低延遲的無損傳輸: 傳統網路在擁堵時會「丟包」,就像信使在路上把信弄丟了,需要總部重新再寄一次,浪費了寶貴的時間。而 InfiniBand 採用了精密的流量控制,從根本上杜絕了數據包的丟失。它是一條絕對可靠、暢通無阻的專用通道,確保了微秒級的超低延遲。

RDMA (遠端直接記憶體存取) 的靈魂: 這是 InfiniBand 的真正靈魂所在。傳統乙太網的通訊,就像兩位大腦(GPU)需要透過各自的秘書(CPU)來傳話,不僅要轉述,還要記錄和處理,過程繁瑣且緩慢。而 InfiniBand 的 RDMA 技術,則賦予了這些大腦一種近乎「心電感應」的能力。它允許一台伺服器裡的 GPU,直接讀寫另一台遠在天邊的伺服器裡的 GPU 記憶體,完全繞過了雙方 CPU 的干擾。對於 AI 訓練中海量的權重同步任務來說,這種效率的提升是革命性的。

InfiniBand 並非 NVIDIA 從零創造的私有協議,而是一個由行業協會(InfiniBand Trade Association)維護的開放標準,早已在超級電腦領域稱霸多年。

然而,NVIDIA 的高明之處在於,它沒有去重新發明輪子,而是直接收購了這個標準下最主要的、近乎壟斷的硬體供應商——Mellanox。

這一舉動,巧妙地將一個名義上的「公共資源」,變成了自己帝國版圖中事實上的「私有領地」。

收購 Mellanox,這一神來之筆,讓 NVIDIA 的戰略版圖瞬間完整。至此,NVIDIA 帝國的雙重神經系統終於構建完成:

內部神經系統 (Scale-up): 以 NVLink 為脊髓,將單一伺服器內的 GPU 大腦高速連接,形成一個強大的「個體」。

外部神經系統 (Scale-out): 以 InfiniBand 為網絡,讓數千個這樣的「個體」能夠進行心電感應般的交流,融合成一個龐大、統一、無比協調的「超級意識體」(AI 叢集)。

這一垂直整合讓NVIDIA的角色徹底蛻變,從零件商變成了唯一能交付整座「AI超級工廠」的總建築師。至此,其硬體帝國的雙重佈局完成:內部用NVLink封鎖入口,外部用InfiniBand控制出口。也正是這種密不透風的統治,最終點燃了整個行業的反抗之火。

本章小結

戰略收購:NVIDIA透過收購Mellanox,將超級電腦領域的王者級網路技術InfiniBand納入囊中,補全了其Scale-out(伺服器間互連)的版圖。

事實上的壟斷:儘管InfiniBand是一個開放標準,但NVIDIA收購了市場上近乎壟斷的供應商,巧妙地將其變成了自己生態中的一環。

雙重壁壘完成:至此,NVIDIA構建了完整的硬體護城河:內部用NVLink鎖定Scale-up,外部用InfiniBand主導Scale-out,從零件商蛻變為AI工廠的總建築師。

第四章:反抗的序曲 — 從「戰國七雄」到「書同文」

在前面兩章,我們見證了 NVIDIA 帝國如何用 NVLink 和 InfiniBand 構建了一個從內到外、高度統一的算力王朝。

面對這座銅牆鐵壁,是群雄割據的「戰國時代」。

AMD、Intel、Google 等巨頭都鑄造了屬於自己的「神兵利器」——私有的高速互連技術。AMD 的 Infinity Fabric、Google 的 ICI等等,在其各自的「城邦」內都擁有驚人的速度和效率。

這就引出了一個核心問題:既然大家都有自己的高速公路,為什麼不能各自為政,各建各的王國呢?為什麼非要聯合起來,推動 UALink 這個統一標準?

答案是,這些看似強大的獨立城邦,正遭受著四個「詛咒」,讓它們在統一的帝國面前不堪一擊。UALink 的誕生,正是為了打破這些詛咒。

為何不能各自為政?— 「巴別塔」的四大詛咒

想像一下聖經故事中的巴別塔:人們試圖建造一座通天高塔,但上帝讓他們說不同的語言,於是溝通失效,協作崩潰,宏偉的工程最終化為泡影。

這正是 UALink 誕生前,非 NVIDIA 陣營面臨的困境。

詛咒一:軟體開發的噩夢

AI 軟體(如 PyTorch、TensorFlow)的開發者,為了讓程式在不同硬體上高效運行,必須為每一種私有互連技術寫一套完全不同的優化代碼。這就像你寫了一本曠世奇書,但要出版時,必須親自將它翻譯成英文版(給 NVIDIA)、德文版(給 AMD)、法文版(給 Intel)和拉丁文版(給 Google)。這極大地拖慢了整個 AI 生態的創新速度。

詛咒二:供應商鎖定的「黃金牢籠」

當一個雲端服務商(如微軟、亞馬遜)選擇了某個廠商的加速器,他們就被迫要購買該廠商的全套專有方案——包括晶片、特製的交換機和特製的線纜。這就像你買了一台蘋果手機,就只能用蘋果的充電器。缺乏競爭意味著更高的價格和更少的選擇權,客戶失去了議價能力。

詛咒三:超大規模資料中心的困境

對於需要部署數十萬甚至上百萬個 GPU 的 Google、Meta 這樣的巨頭來說,管理多個互不兼容的硬體體系是一場災難。想像一下,你是一家大型航空公司,但你的機隊裡有波音、空客和龐巴迪的飛機。每一種飛機都需要不同的飛行員、不同的維修工具和不同的後勤團隊。採購、庫存、維護、人員培訓的成本高到難以承受。

詛咒四:無法逾越的技術鴻溝

AI 訓練,特別是大型模型,需要在數百個 GPU 之間建立一個像「單一大腦」一樣的統一記憶體空間。如果底層的互連「語言」不同,這個「大腦」就會被分割成無數個無法順暢交流的小腦,性能大打折扣。僅僅在外部用標準乙太網連接這些「小腦」是不夠的,因為內部的「神經元」連接方式已經完全不同。